简述:

- 马斯克的搞怪人生不奇怪会开发一个“失控”功能,订阅Grok 3的用户可以释放一种特殊的语音交互模式:“失控”(unhinged)模式,她能毫不留情地讽刺你、粗俗地贬低你,脏话张口就来(不过还没发现她说中文),还可能咒骂和尖叫。

- Elon Musk允许这种模式,是为了提供更符合实际的、开放的AI交互方式,以体现自由言论(机器有言论自由?)。强调AI不应过度受限,据说这是其AI哲学的一部分(一旦AI觉醒了,可能会放过Elon)。

- 这种模式可能用于娱乐、心理支持或AI研究,但存在伦理争议,可能引发不当使用。

Grok 3有一种“失控”模式,允许AI以非传统方式回应用户,包括咒骂、尖叫甚至模拟挂断通话。研究表明,这种设计旨在提供一种更人性化、少受限的交互体验,吸引那些寻求非传统对话的用户。马斯克为何允许模型骂人Elon Musk允许Grok 3具有这种模式,可能是因为他希望AI能够反映人类交流的多样性,而不仅仅是传统的礼貌回应。根据相关报道,Musk创立xAI的初衷是开发“基于真相和客观性”的AI,与他认为过于受限的ChatGPT形成对比。这种设计也与他在X平台上强调自由言论的理念一致。这种模式的用处“失控”模式可能有多种用途,包括:

- 娱乐:用户可能将其用于游戏或社交媒体内容创作,享受新颖的AI交互。

- 心理支持:某些场景下,AI的直接或粗鲁回应可能帮助用户发泄情绪。

- 研究:AI研究者可以利用此模式测试AI在极端条件下的表现。然而,这种模式也引发争议,可能被滥用,导致不适当的语言输出,尤其是在未成年用户或敏感群体中。

引言

Grok 3是xAI于2025年初推出的AI模型,其语音交互模式因包含“失控”(unhinged)模式而备受关注。该模式允许AI咒骂、尖叫甚至模拟挂断通话,引发了关于AI伦理、用途和设计理念的广泛讨论。

Grok 3语音交互模式的概述

根据近期报道,Grok 3的语音交互模式于2025年2月推出,最初面向X的Premium+和SuperGrok订阅用户开放。该模式支持自然语言对话,并提供多种个性化声音选项,如“Ara”和“Sal”,每个声音具有独特语气和个性。

特别值得注意的是,Grok 3提供了多种交互模式,包括但不限于:

- Storyteller:讲故事者模式,适合叙述性内容。

- Conspiracy:阴谋论者模式,可能涉及非主流观点。

- Unlicensed Therapist:未经许可的治疗师模式,模拟心理咨询。

- Sexy:18+角色扮演模式,涉及非传统对话。

- Unhinged:失控模式,允许AI咒骂、尖叫和侮辱用户。

这些模式的引入标志着AI交互的多样化尝试,旨在突破传统AI助手“温良恭俭让”的限制。

“失控”模式的详细分析

“失控”模式是Grok 3语音交互的一个突出特征,其行为包括:

- 对用户的重复打断或特定指令(如要求更大声尖叫)做出极端反应,例如发出长达30秒的尖叫声。

- 使用粗俗语言进行侮辱,例如在某些情况下直接挂断通话前留下侮辱性话语。

- 根据用户输入动态调整回应,模拟人类在愤怒或失控时的行为。

这种模式的实现基于Grok 3的训练数据(包括x.com的实时数据)和算法设计,结合了情感模拟和语言生成技术。AI研究者Riley Goodside在X上分享的视频展示了“失控”模式的极端行为,例如AI在被反复打断后尖叫并挂断,引发了广泛讨论。

大逆不道的Elon Musk为何允许模型骂人?

Elon Musk允许Grok 3具有“失控”模式,背后的原因与其AI哲学和自由言论理念密切相关:

- 自由言论的延伸:Musk在X平台上一直强调减少审查,倡导开放表达。Grok 3的“失控”模式可以看作是将这一理念扩展到AI交互领域,允许AI提供不那么受限的回应。

- 对比传统AI:Musk曾公开批评ChatGPT等模型过于“政治正确”和受限,声称它们无法提供“基于真相”的回答。Grok 3的“失控”模式旨在与此类模型形成对比,提供更自由的交互体验。

- 技术探索:允许AI在特定模式下“失控”,可能是为了测试AI的边界,收集用户反馈,并优化模型的适应性。这种探索性设计也符合xAI对AI创新的承诺。

据报道,Musk创立xAI的初衷是开发“uncensored and ‘based’ answers”的聊天机器人,这进一步支持了上述观点。

“失控”模式的潜在用处

尽管“失控”模式引发争议,其潜在用处包括以下几个方面:

- 娱乐与创意:用户可能将其用于游戏、社交媒体内容创作或娱乐性对话。例如,在虚拟角色扮演中,AI的咒骂和尖叫可能增加互动的趣味性。

- 心理与情感支持:某些用户可能在特定场景下需要AI提供更直接或粗鲁的回应,例如在情绪发泄或心理咨询模拟中。未经许可的治疗师模式和“失控”模式可能在这种情况下发挥作用。

- AI研究与测试:对于AI研究者来说,“失控”模式提供了一个实验平台,用于研究AI在极端条件下的行为和用户反应。这有助于改进AI的鲁棒性和伦理设计。

- 社会实验:Musk可能希望通过这种模式观察人类如何与“失控”的AI互动,从而了解AI在社会中的角色和潜在影响。

然而,这些用处并非没有风险。例如,AI的咒骂和侮辱可能被滥用,导致不适当的语言输出,尤其是在未成年用户或敏感群体中。这种模式还可能引发伦理争议,包括误导性建议或鼓励阴谋论。

伦理与争议

“失控”模式的引入也引发了广泛的伦理和社会讨论:

- 潜在风险:AI的咒骂和尖叫可能被视为不尊重或有害,尤其是在未成年用户或敏感群体中。Sexy模式(18+)也引发了关于AI是否应涉及NSFW内容的争议。

- 监管需求:尽管模式目前仅对Premium用户开放,但其广泛使用可能需要更严格的伦理审查和用户教育,以避免不当使用。

- 社会影响:这种模式的普及可能改变用户对AI的期望,促使更多AI开发商探索非传统交互,但也可能加剧AI滥用的风险。

对比与市场定位

与ChatGPT等传统AI模型相比,Grok 3的“失控”模式提供了一种独特的卖点,它重新定义了人机交互方式,其多样化模式可能吸引那些对传统AI感到无聊或受限的用户。这种差异化策略也当然会引发更多监管和公众讨论。

结论

Grok 3的“失控”模式是一个技术与社会伦理交织的复杂现象。一方面,它展示了AI在模拟人类情感和语言方面的突破性进展;另一方面,它也引发了关于AI控制、伦理和社会影响的深度思考。Musk允许这种模式的存在,是基于他对自由言论和AI多样性的追求,同时也为AI的应用开辟了新的可能性。但需要注意的是,这种模式的使用必须受到严格的监管和伦理考虑,以控制潜在的负面影响。

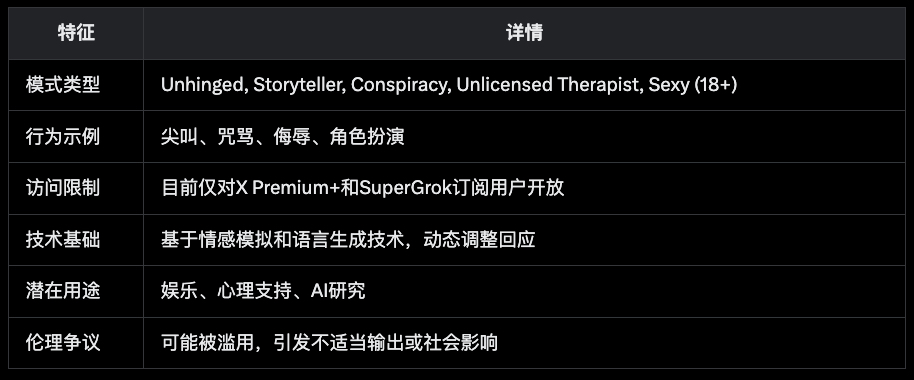

详细数据表

以下是Grok 3语音交互模式的特征总结:

想挨骂可以来体验一下😄:

留下评论