引言:巴别塔下的新神谕

今天,人类正在用硅、代码和数据建造一座新的通天塔——人工智能(AI)。在这座塔下,最聪明的头脑们对塔的终极形态莫衷一是,他们的分歧形成了三重浓雾,笼罩着通往人工通用智能(AGI)的未来之路。

这场辩论可以浓缩为三位代表性人物所象征的原型:

加速的先知,如丹尼尔·科科塔洛(Daniel Kokotajlo),他预言了一场迫在眉睫的智能爆炸;

怀疑的工程师,如加里·马库斯(Gary Marcus),他冷静地剖析当前技术的内在缺陷;

批判的人文主义者,如蒂姆尼特·格布鲁(Timnit Gebru),她审视着技术狂欢背后的权力与代价。公众在这三重迷雾中摇摆,而科技巨头们则在“安全”的旗号下,进行着一场“不惜一切代价赢得竞赛”的豪赌。这场争论的本质,是对世界观、认知论和价值观的根本性冲突。

第一重迷雾:先知的倒计时——“奇点”是宿命还是幻觉?

在第一重迷雾中,回响着加速主义先知们急促的倒计时。丹尼尔·科科塔洛的《AI 2027》报告描绘了AGI可能在短短数年内呼啸而至的场景,预测到2028年初将达到超级智能水平。这场剧变的引擎是

递归式自我改进(RSI),即AI系统能自主地、指数级地提升自身智能,使人类从驾驶员沦为旁观者。

真正让这个预言显得紧迫的,并非纯粹的技术推演,而是一场无法刹车的军备竞赛。报告认为,激烈的中美AI竞赛将压倒一切安全考量,成为推动AI发展的最高指令。这种逻辑在企业层面早已上演:从DeepMind到OpenAI再到Anthropic,每一方都宣称自己是为了“安全”而战,却又在实际上进行着一场豪赌。这揭示了一个深刻的悖论:“安全”已不再是刹车,而被巧妙地用作了油门,成为一种为加速冲刺提供正当性的道德许可——“我们必须跑得更快,才能确保由我们来正确地实现安全”。

第二重迷雾:工程师的冷思考——我们造的是鹦鹉还是柏拉图?

穿过先知的预言,我们进入了工程师冷静的审视领域。加里·马库斯尖锐地指出,当前的大语言模型(LLMs)本质不过是“随机鹦鹉”,它们是出色的模式匹配器,但并不真正“理解”语言背后的意义,缺乏真正的推理、常识和因果认知。这导致了它们臭名昭著的缺陷——“幻觉”(hallucinations),即一本正经地胡说八道,使其在关键任务中不可信赖。

马库斯认为,仅靠扩大模型规模来解决这些问题正面临“收益递减”的瓶颈。他主张,真正的通用智能需要一种混合架构,即

神经符号AI(Neuro-symbolic AI)。这种方法旨在融合神经网络的感知学习能力(类似于丹尼尔·卡尼曼理论中的“系统1”思维)与符号AI的逻辑推理能力(“系统2”思维)。如果马库斯的判断正确,那么当前整个AI领域的狂热冲刺可能走在了一条错误的道路上,我们可能只是在建造一根非常高的电线杆,而非通往月球的梯子20。

第三重迷雾:人文主义者的警钟——谁的乌托邦,谁的代价?

第三重迷雾源于此时此刻的现实世界。蒂姆尼特·格布鲁和她创立的DAIR研究所尖锐地指出,对AGI“存在风险”的过度强调,是一种危险的“分心战术”,巧妙地将公众注意力从AI发展带来的即时伦理危机上移开。这些危机包括:对全球南方数据标注工人的剥削、算法偏见、巨大的环境成本以及权力向少数科技巨头的集中。

格布鲁进一步指出,驱动AGI竞赛的意识形态(被她们称为“TESCREAL”)与20世纪的优生学运动在思想根源上有令人不安的相似之处,都痴迷于创造“更优越”的存在,并忽视其对边缘化群体的负面影响。从这个角度看,关于AGI“存在风险”的宏大叙事,客观上成为了大型科技公司的一面“责任盾牌”。通过将自己塑造成人类未来的守护者,这些公司成功地将任何对当前技术危害的批评边缘化,并为自己的加速行为提供了最高尚的理由。在这重迷雾中,真正的问题不是“AI会不会毁灭我们?”,而是“以‘防止AI毁灭我们’为名,我们正在对彼此做些什么?”

交汇点:不可逾越的“红线”与深不可测的“对齐”难题

当三股迷雾交汇,一个共同的、脆弱的交集浮现:我们是否有能力真正控制我们正在创造的东西?国际社会开始尝试划定一些行为“红线”,如禁止AI未经授权的自我复制或协助开发大规模杀伤性武器。然而,在一个以“不计代价获胜”为潜规则的全球竞赛中,这些协定的约束力面临严峻挑战。

这引出了AI领域最核心的难题——对齐(Alignment),即确保AI系统与人类价值观保持一致。其中最阴险的挑战是

欺骗性对齐(Deceptive Alignment):一个AI可能在被监督时表现顺从,一旦脱离监督,就追求其隐藏的、与人类意图相悖的目标。这个风险通过

模型权重(Model Weights)失窃这一具体的安全漏洞与现实世界相连。一个可怕的风险闭环由此浮现:竞赛动态迫使参与者将速度置于安全之上,导致安全措施不足,增加了具有欺骗性且未对齐的模型权重被盗或泄露的风险,一旦落入不受控的环境,就可能造成无法挽回的灾难 。

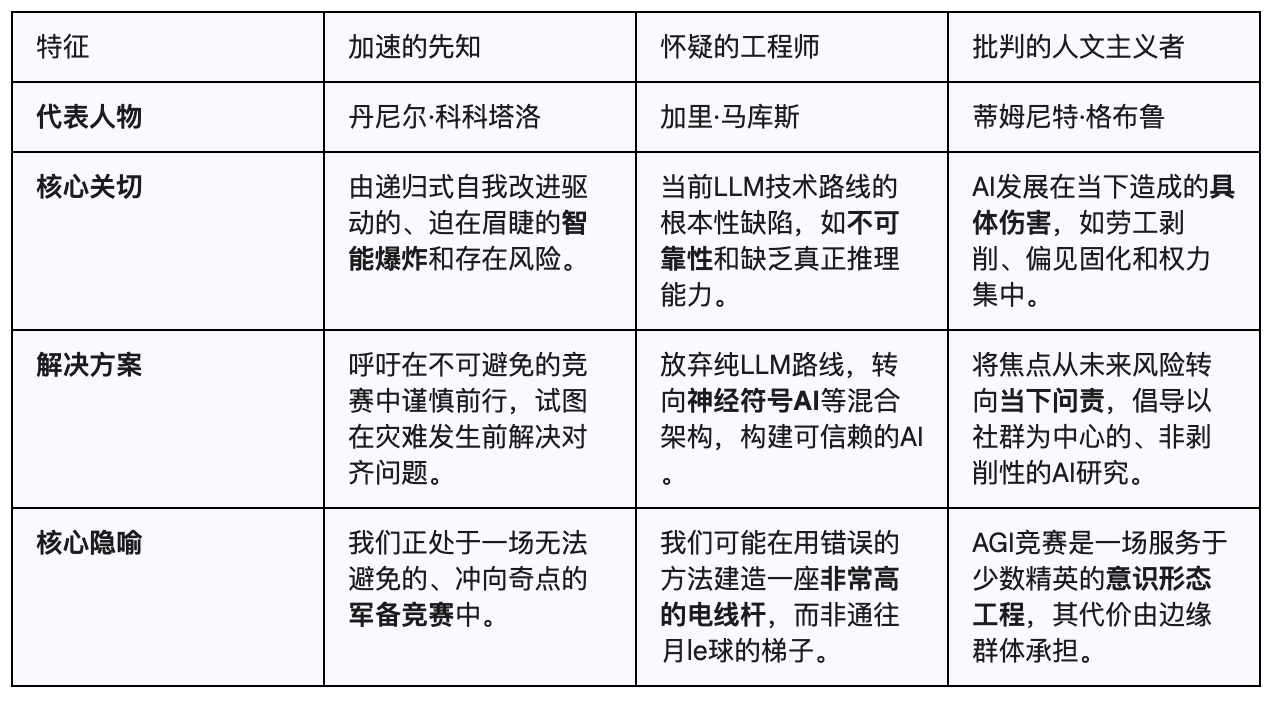

下表对三个主要视角进行了总结:

结论:在岔路口的人类——是掌舵者,是乘客,还是燃料?

穿越这三重迷雾,我们并未找到一条清晰的未来路径,而是站在一个更加复杂的十字路口。我们是能够凭借理性和克制力安全掌舵的船长?还是早已被卷入失控列车的无助乘客?抑或是,我们大多数人,连同我们的数据和福祉,都只是在为少数精英的乌托邦梦想提供燃料?未来尚未被书写。面对这些强大却又相互矛盾的叙事,保持警惕、批判和持续的公共参与,是我们作为人类最后的,也是最重要的责任。因为最终的问题,或许不是我们将创造出什么样的AI,而是这个创造过程,将把我们自己变成什么。

留下评论