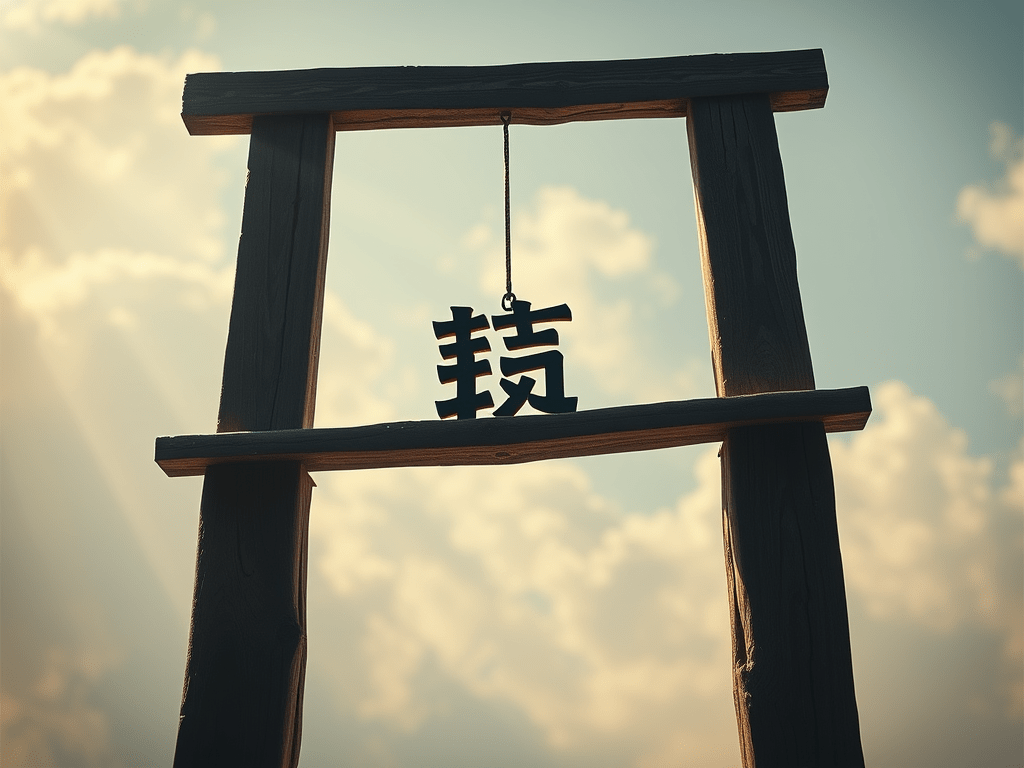

第五回: 失衡的木梁——当"胜利"压倒风险

在华盛顿特区安德鲁·W·梅隆礼堂的那个夏日下午,当特朗普总统宣布"在AI竞赛中,第二名就是最后一名"时,台下爆发出热烈的掌声。这句话后来成为新一轮美国AI政策的核心理念,但很少有人意识到,这种"胜利至上"的思维模式正在将美国的AI发展置于一种危险的状态。

就像一根承重的木梁,当"胜利"的重量过度集中在一端时,整个结构就面临着坍塌的风险。这本是AI内部所谓有效加速主义(E/Acc)与超级对齐主义(Super Alignment)的最大分歧,特朗普政府的AI战略显然是全盘倒向了前者,虽然在竞争力方面展现出前所未有的决心,但对潜在风险的系统性忽视,可能正在为美国AI发展埋下深层的隐患。

竞争逻辑的全面胜利

在特朗普政府的AI政策框架中,一切都服务于一个终极目标:确保美国在AI竞赛中的绝对胜利。这种竞争逻辑是如此彻底,以至于传统上被视为重要考量的因素——安全性、公平性、可持续性——都被重新定义为竞争力的函数。

安全性不再是技术安全,而是国家安全。新政策更关心的不是AI系统是否会产生有害输出,而是美国是否会在AI军备竞赛中落后。伦理考虑不再是算法公平,而是避免"觉醒AI"削弱美国的技术竞争力。环境影响不再是碳排放控制,而是确保数据中心建设不受"激进气候教条"的阻碍。

这种重新定义的结果是一套高度一致但潜在危险的政策体系。每一项具体措施都指向同一个方向:最大化短期竞争优势,最小化监管约束。从快速审批数据中心建设到放松环境法规,从简化政府采购流程到取消安全测试要求,整个政策架构都在为一个目标服务——让美国在AI竞赛中跑得更快。

被边缘化的风险考量

在这种竞争至上的框架下,传统的风险管理考量被系统性地边缘化。最明显的例子是对AI系统安全测试要求的大幅放松。拜登时代要求对超过10^26 FLOPs算力的大型模型进行政府安全评估,特朗普政府则认为这种要求会"扼杀创新"。

这种态度变化的背后是一个根本性的风险哲学转变:从"预防原则"转向"接受风险"。在新的框架下,AI系统可能带来的潜在危害被视为可以接受的代价,只要这种代价不影响美国的竞争地位。

更令人担忧的是对社会风险的忽视。AI技术的大规模部署可能导致的就业冲击、收入不平等加剧、社会结构变化等问题,在新政策中几乎没有得到任何关注。这种忽视的逻辑是:只要美国在AI竞赛中获胜,这些社会问题自然会得到解决;如果美国落败,讨论这些问题就毫无意义。

环境代价的盲区

特朗普AI政策中最明显的风险盲区是对环境影响的系统性忽视。AI模型的训练和运行需要消耗巨量的电力和水资源,但新政策不仅没有对此设定限制,反而积极地为AI产业的资源消费开绿灯。

政策明确表示要为AI数据中心建设提供NEPA(国家环境政策法)豁免,放松《清洁空气法》和《清洁水法》的约束。这意味着在追求AI竞争优势的过程中,美国愿意牺牲其在环境保护方面的长期承诺。

具体数据更能说明这种牺牲的规模。根据国际能源署的预测,到2030年,全球数据中心的电力需求将从目前的200TWh增长到超过1000TWh,相当于整个日本的年用电量。如果这种增长主要由化石燃料驱动,其碳排放影响将是巨大的。

更讽刺的是,这种对环境代价的忽视可能最终削弱美国的AI竞争力。气候变化导致的极端天气事件已经开始影响数据中心的正常运行,缺乏可持续性考虑的AI基础设施可能在长期竞争中变成劣势而非优势。

人才流失的隐性风险

另一个被严重低估的风险是人才流失。特朗普政府的"反觉醒AI"政策虽然在政治上颇受支持,但在学术和技术社区中引起了广泛的担忧和反对。

许多顶尖的AI研究者担心政治意识形态对科学研究的干预。当政府开始规定AI系统应该输出什么样的内容、避免什么样的"偏见"时,这种干预被视为对学术自由的威胁。一些研究者已经开始考虑转移到政策环境更加稳定的国家。

这种人才流失的风险在短期内可能不明显,但长期影响是深远的。AI技术的核心竞争力在于人才,而人才的国际流动性很高。如果美国因为政策环境的变化失去对全球顶尖AI人才的吸引力,那么再多的资本投入也无法保证长期的技术领先。

创新生态的脆弱性

"胜利"导向的政策还可能损害美国AI创新生态的多样性和韧性。通过政府采购政策的引导,新政策实际上在推动AI产业向特定方向发展——更加注重效率和竞争力,较少关注安全性和社会影响。

这种导向可能导致创新生态的单一化。当所有企业都朝着同一个方向努力时,整个生态系统的抗风险能力就会下降。如果某个技术路径被证明是错误的,或者某个竞争策略失效,缺乏多样性的生态系统就很难快速调整。

更深层的问题是,这种政策导向可能抑制那些在短期内看不到商业价值但具有长期重要性的基础研究。AI安全、AI伦理、AI可解释性等领域的研究可能因为不符合"竞争至上"的要求而得不到足够的资源支持。

国际关系的代价

过度的竞争导向还可能损害美国在AI领域的国际合作能力。新政策将AI技术明确定位为地缘政治工具,通过技术出口和标准设定来维护美国的全球影响力。

这种做法虽然可能在短期内巩固美国的技术优势,但也可能激发其他国家的反制措施。当AI技术被高度政治化时,国际合作就变得更加困难。一些需要全球协调的AI挑战——如AI安全标准、AI伦理规范、AI军备控制等——可能因为缺乏合作而得不到有效解决。

民煮价值的侵蚀

或许最深层的风险在于对美国民主价值的潜在侵蚀。当政府开始规定AI系统应该体现什么样的价值观、避免什么样的"偏见"时,这种做法与另一类国家对AI内容的控制在本质上有什么区别?

"防止觉醒AI"的政策虽然包装在反对意识形态偏见的话语中,但实际上是在推行另一种意识形态。这种做法可能为未来更广泛的思想控制开创先例,对美国的言论自由传统构成威胁。

历史的警示

历史告诉我们,当一个国家为了短期竞争优势而忽视长期风险时,往往会付出惨重代价。苏联在太空竞赛中的短期胜利并没有拯救其最终的衰落,日本在1980年代的经济奇迹也没有防止其后来的长期停滞。

在AI竞赛中,类似的风险同样存在。过度关注短期竞争优势而忽视可持续发展,可能导致技术发展的不平衡和不稳定。当木梁失去平衡时,整个结构的坍塌往往是突然而彻底的。

寻找新的平衡

这并不意味着竞争力不重要,而是说需要在竞争力与其他价值之间找到更好的平衡。真正可持续的AI领导地位应该建立在技术卓越、社会责任、环境可持续和国际合作的综合基础之上。

一些迹象表明,即使在特朗普政府内部,也有人开始意识到这种失衡的风险。一些政策制定者私下承认,完全忽视AI风险可能最终损害美国的长期竞争力。关键问题是,这种认识能否转化为政策调整,在追求胜利的同时避免不必要的风险。

在这场决定人类未来的AI竞赛中,真正的胜利者应该是那些既能保持技术领先,又能有效管理风险的国家。失衡的木梁虽然可能在短期内承载更大的重量,但只有平衡的结构才能承受时间的考验。这或许是当前美国AI政策最需要思考的问题。

留下评论