第五篇 算法鸿沟:公共图书馆的桥梁使命

在北京某社区图书馆,一位60多岁的李阿姨拿着手机,焦急地向馆员求助:“我女儿说让我用这个‘人工智能’查菜谱,可我问它‘晚上吃什么’,它给我说了一大堆,我也不知道它到底什么意思……”就在同一天,这座城市的另一端,一位年轻的自由职业者正熟练地用AI生成客户提案、设计海报、甚至编写简单的程序,工作效率是同行的数倍。

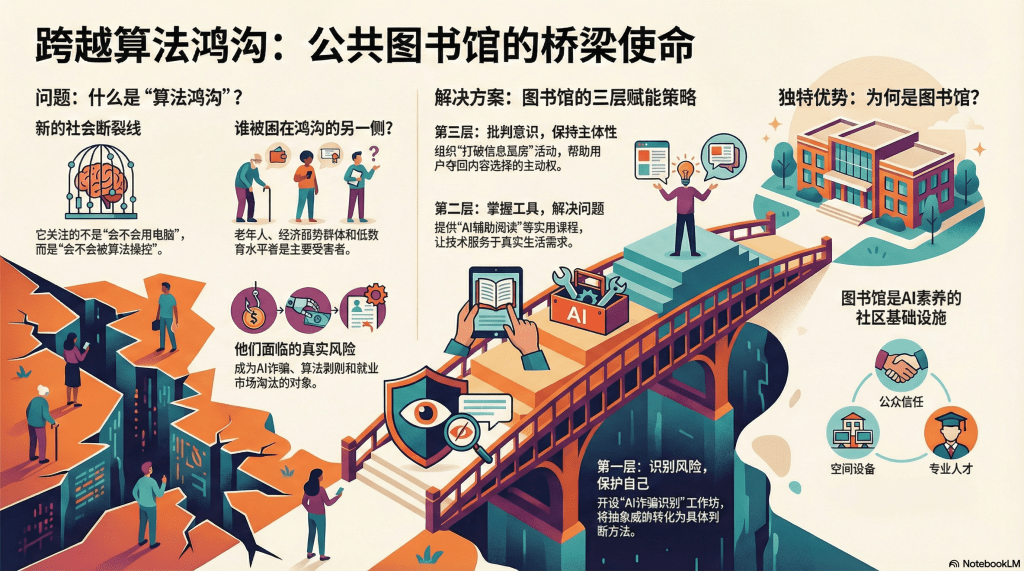

这两个场景,勾勒出当代社会一条新的断裂线:算法鸿沟。它不同于传统的“数字鸿沟”——后者关注的是“有没有网络接入”“会不会用电脑”,而算法鸿沟关注的是“能不能理解并驾驭AI”“会不会被算法操控”。这条鸿沟正在以惊人的速度撕裂社会:一侧是AI的熟练使用者,他们享受技术红利,效率倍增;另一侧是被技术遗忘的人群——老年人、低收入者、低教育水平者——他们不仅无法享受便利,还可能成为算法欺诈的受害者、推荐系统的操纵对象、就业市场的淘汰者。

公共图书馆,作为社会的“文化客厅”和“知识平权”的最后堡垒,能为填补这条鸿沟做什么?答案不是简单地开几场“ChatGPT使用讲座”,而是系统性地将AI素养改造为生存技能,让每一个走进图书馆的人,都能获得在算法社会中自我保护和自我实现的能力。

被遗忘者的画像:谁在鸿沟的另一侧?

在谈解决方案之前,我们必须先看清问题的面貌。算法鸿沟不是均匀分布的,它有明确的受害群体:

首先是老年人。中国60岁以上人口已超2.6亿,其中绝大多数在智能手机普及后才第一次接触数字技术。他们错过了从PC时代积累数字素养的窗口期,直接“空降”到AI时代——连基本的“什么是云端存储”都没搞明白,就要面对“多模态大模型”。

更严峻的是,老年人往往是AI诈骗的重灾区。深度伪造技术可以模仿子女的声音打电话索要钱财,AI生成的虚假“专家”在短视频里推销假药,算法精准推送的养生谣言让老人深信不疑。这不是“不够聪明”,而是他们成长的时代没有“信息可以被完美伪造”的认知基础——他们习惯了“眼见为实”“耳听为真”,而这些铁律在AI时代全部失效。

其次是经济弱势群体。AI工具的“免费”是有代价的——通常是数据交换。一个无法理解“隐私政策”的人,可能在不知不觉中出卖了自己的行为数据、面部特征、语音纹理。更隐蔽的剥削是“算法劳动”:外卖骑手受困于算法设定的配送时间,网约车司机被平台的动态定价操控,这些人成为算法系统中的“零件”,却无力理解或反抗这套支配逻辑。

还有教育水平较低者。当招聘越来越依赖AI筛选简历,那些不懂得如何“优化关键词”以通过算法初筛的求职者,在见到真人HR之前就被淘汰了。当行政服务搬到“智能政务平台”,那些看不懂复杂界面、不会上传材料的人,被挡在公共服务的门外。技术本应提升效率,却在客观上加剧了不平等。

这些群体的共同特征是:他们不是拒绝技术,而是被技术拒绝。现有的AI产品设计,往往假设用户具备一定的数字素养、经济能力和学习意愿,却忽视了大量不符合这个“标准画像”的真实人群。而公共图书馆,恰恰是这些人仍然信任、仍然会踏入的公共空间。

从“扫盲”到“赋能”:图书馆的AI素养策略

面对算法鸿沟,图书馆的AI素养教育不能照搬高校或企业的模式——那些面向年轻人、专业人士的课程,对这些弱势群体完全不适用。我们需要的是降低门槛、聚焦实用、强化保护的“生存型AI素养”。

第一层:识别风险,保护自己。这是最紧迫的需求。在教会老人使用AI之前,先教会他们如何不被AI伤害。

一个具体的课程设计:“如何识别AI诈骗”。内容包括:

- 深度伪造音视频的识别技巧(观察背景是否融合自然、声音是否有机械感、是否刻意回避某些角度)

- 虚假客服的判断方法(正规客服不会要求转账到私人账户、不会索要验证码、不会让你下载不明软件)

- AI生成虚假信息的常见破绽(日期混乱、人物关系矛盾、细节经不起推敲)

这类课程的关键是案例驱动。不要讲“什么是生成对抗网络”,而是播放真实的诈骗电话录音,手把手教学员:“听,这里的停顿不自然,真人不会这样说话。”“看,这个‘银行通知’的logo像素很低,正规机构不会这么粗糙。”把抽象的技术威胁转化为具体的判断规则,老人才能记住并应用。

第二层:掌握工具,解决问题。当建立了基本的风险意识,下一步是让技术真正服务于生活。

一个高频需求是“AI辅助阅读”。许多老年读者视力下降,阅读纸质书吃力,但又不习惯电子书。图书馆可以开设“AI朗读工作坊”,教学员:

- 如何用手机的OCR(光学字符识别)功能扫描书页,转为文字后用AI朗读

- 如何调节语速、音色,找到最舒适的听书体验

- 如何用AI总结长文章,快速把握要点

这类课程的设计要点是任务导向+即时反馈。不要从原理讲起,而是直接给学员一本他们感兴趣的书,现场完成“扫描-转文字-朗读”的全流程,让他们立即感受到“学了就能用”的成就感。

另一个实用场景是“AI协助办事”。很多人被政务服务平台的复杂流程劝退,图书馆可以提供“AI助手”:

- 教读者如何用语音向AI询问“办理退休手续需要准备什么材料”

- 如何让AI帮忙填写表格(通过语音输入信息,AI转换为标准格式)

- 如何用AI翻译外文文件(对于外来务工人员尤其重要)

这里的关键是降低心理门槛。许多人不敢用AI,不是因为操作难,而是怕“问错问题很丢人”。图书馆可以营造一个“没有愚蠢问题”的氛围,馆员要反复强调:“AI不会嘲笑你,你可以随便问,问不好就重新问。”

第三层:批判意识,保持主体性。当人们学会了使用AI,新的风险出现:过度依赖、丧失判断。

一个值得重视的现象是算法茧房。许多中老年人沉迷于短视频平台,算法根据他们的观看习惯,不断推送同质化内容——养生谣言、情绪煽动、阴谋论。他们不知道“我看到的”只是“算法想让我看到的”,误以为这就是全世界。

图书馆可以设计“打破信息茧房”主题活动:

- 用可视化工具展示“你的推荐页面 vs 其他人的推荐页面”,让学员直观看到差异

- 组织“反向阅读”挑战:每周刻意浏览一个与自己观点相反的内容,然后小组讨论“为什么有人会这么想”

- 教学员主动“训练算法”:通过点击“不感兴趣”“屏蔽此类内容”,重新掌握内容选择权

这类活动的目标不是让人放弃使用推荐系统——那不现实,而是让人意识到推荐是可以被干预的,主动权在你手中。

一个完整的课程案例:“AI时代的安全网”

让我用一个完整的课程设计,来展示公共图书馆如何系统化地填补算法鸿沟:

课程名称:安全上网,智慧生活——中老年人AI防护指南

第一课:认识你的“数字邻居”

- 用动画短片介绍AI:它像一个很能聊天但记性不好的助手

- 体验三个AI:语音助手(问天气)、图像识别(拍照识花)、文本生成(让AI写祝福语)

- 小组讨论:你愿意让AI帮你做什么?不愿意让它做什么?

第二课:当心“假李鬼”

- 案例分析:三个真实的AI诈骗案例(深度伪造视频、假客服、虚假投资广告)

- 角色扮演:馆员扮演诈骗者,学员练习如何应对

- 建立“三问原则”:遇到可疑信息,问自己“消息来源可靠吗?”“要求合理吗?”“有人验证过吗?”

第三课:AI帮我读好书

- 实操:每人带一本想读的书,用手机APP完成扫描-朗读

- 进阶:用AI总结新闻,快速了解时事

- 课后作业:用AI朗读功能“听”完一本书,下次课分享

第四课:夺回我的选择权

- 实验:让学员对比自己的抖音推荐页和子女的,讨论差异

- 学习:如何设置“不感兴趣”,如何搜索而不只依赖推荐

- 承诺:每天至少读一篇“不是算法推荐”的内容

第五课:我也能教别人

- 学员结对,互相教一个本期学到的技能

- 制作“防诈骗提示卡”,分发给社区其他老人

- 颁发“AI素养实践者”证书

这个课程设计有几个特点:

- 递进式:从认知到防护到应用到反思

- 体验式:每节课都有动手环节,不只是听讲

- 社交化:通过小组讨论、角色扮演,让学习变成社交活动(老年人尤其需要这种归属感)

- 赋能感:最后让学员成为“教育者”,强化学习成果,也让他们感受到“我也可以帮助别人”的价值

图书馆:低门槛AI体验中心的独特优势

为什么是图书馆,而不是社区中心、老年大学或商业培训机构?因为图书馆具有三个独特优势:

第一,信任资本。在一个充斥着诈骗、推销、收费课程的环境中,图书馆是少数仍然被普遍信任的公共机构。人们相信这里不会骗他们的钱,不会窃取他们的信息,不会把他们当韭菜。这种信任,让弱势群体愿意迈进来、愿意尝试、愿意求助。

第二,空间优势。图书馆有设备(电脑、平板、AI工具的使用授权),有场地(可以开展活动),有氛围(安静、开放、包容)。更重要的是,它是免费的、常态化的——不是报名才能来的短期课程,而是“随时可以来问”的日常服务。

第三,人才储备。图书馆员经过专业训练,懂信息素养教育,善于根据不同人群调整沟通方式。他们不是技术专家,但恰恰因此能理解初学者的困惑——不会用一堆术语把人吓跑,而是用最平实的语言解释复杂问题。

基于这些优势,图书馆可以将自己定位为“AI素养的社区基础设施”——不是培训中心(那太正式),而是一个随时可以来体验、咨询、学习的空间。具体形态可以是:

AI工具体验区:提供多种AI应用的免费试用(语音助手、图像识别、翻译工具),配有简明使用指南和馆员随时答疑。就像试衣间一样,鼓励“试错”,降低心理压力。

AI咨询台:设置专门时段(如每周三下午),由懂AI的馆员值守,回答读者关于AI的任何问题——从“怎么用ChatGPT”到“我收到这个链接是诈骗吗”都可以问。

AI主题图书专柜:不只是技术书籍,还包括科普读物、批判性反思的社科书、AI伦理的通俗读物,满足不同层次的认知需求。

线上线下结合的“AI伙伴计划”:年轻志愿者与老年学员结对,定期见面教学,也建立微信群随时答疑。图书馆提供空间、教材、组织协调。

从个体赋能到社会干预

但我们必须清醒地认识到:仅靠图书馆的努力,无法彻底填补算法鸿沟。因为这条鸿沟的根源,不只是“知识不足”,更是结构性不平等。

算法本身不中立。当一个智能客服系统主要用标准普通话训练,它就会对方言使用者不友好;当一个健康码系统默认用户拥有智能手机且会操作,它就在事实上排斥了不具备这些条件的人;当一个招聘AI用“名校学历”作为关键筛选项,它就在固化阶层分化。

这些问题,不是开几门课能解决的,需要技术设计层面的干预——让AI系统更包容、更易用。而图书馆,作为连接技术供应商和弱势用户的桥梁,可以在这个过程中发声:

向技术公司反馈用户困难。图书馆可以收集老年读者在使用某款AI应用时的典型问题,整理成报告,提交给开发者。这种来自真实用户的第一手资料,比任何市场调研都有价值。

参与无障碍AI标准制定。就像图书馆推动了无障碍网站、无障碍出版物的标准,也应该推动“无障碍AI”——比如要求语音助手支持方言,要求界面简化到“一键操作”,要求提供“人工兜底”选项(当AI无法理解用户需求时,能转接人工)。

开展算法审计。当政府部门或公共机构采购AI系统(如政务服务AI、公共交通算法调度),图书馆可以作为公民社会代表,参与评估这些系统是否对弱势群体友好、是否存在歧视性设计。

这种从“教育者”到“倡导者”的角色扩展,是公共图书馆在AI时代履行社会责任的必然路径。我们不能满足于“帮助个别人学会用AI”,而要追问“为什么这些人会被排斥在AI之外”,并推动系统性变革。

桥梁,而非岸

算法鸿沟不会自动弥合,技术进步甚至可能加剧分化——当AI越来越智能,那些无法跟上的人,掉队的速度也会越来越快。

公共图书馆的使命,不是把所有人都变成AI专家——那既不可能也无必要。使命是确保每个人都拥有在算法社会中的基本生存和尊严:不被诈骗,不被操控,不被边缘化,并能利用技术改善生活。

这是一座桥,连接“能”与“不能”,连接“新”与“旧”,连接“技术”与“人”。而图书馆,恰好站在桥中央——一边是狂飙突进的技术世界,一边是被甩在身后的普通人。我们的职责,是让这座桥足够宽、足够稳,让每个人都能安全通过。

不是终点,而是过程;不是岸,而是桥——这或许就是公共图书馆在AI时代最诗意也最务实的定位。

留下评论