第一篇:当大模型遇见质性研究——人文学科的十字路口

深夜十一点,社会学系研究生小林盯着电脑屏幕上密密麻麻的访谈记录发愁。三十份深度访谈,每份两万字,她需要在一周内完成编码分析。导师布置这个任务时说:“这是质性研究的基本功,急不得。”可论文截稿日期近在眼前。

就在这时,实验室的师兄探头进来:“要不要试试ChatGPT?我上次用它帮忙编码,一天就搞定了。”小林心动了,但又想起方法论课上老师的告诫:“质性研究是研究者与数据的深度对话,岂能假手于人?”

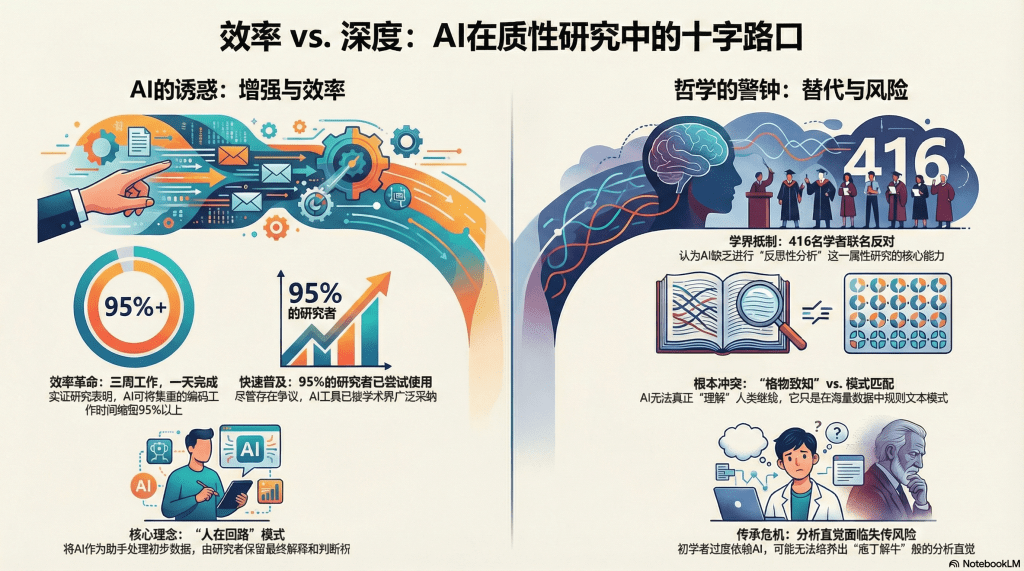

这个场景,正在全球无数社会人文学科的研究者身边上演。2025年的一项调查显示,95%的质性研究者已经至少尝试过使用生成式AI工具。然而就在同年年初,416位国际知名学者联名发表声明,明确拒绝在反思性质性研究中使用AI。这两个看似矛盾的事实,揭示了我们正处于一个前所未有的方法论十字路口。

从“格物致知”到算法预测:认识论的冲击

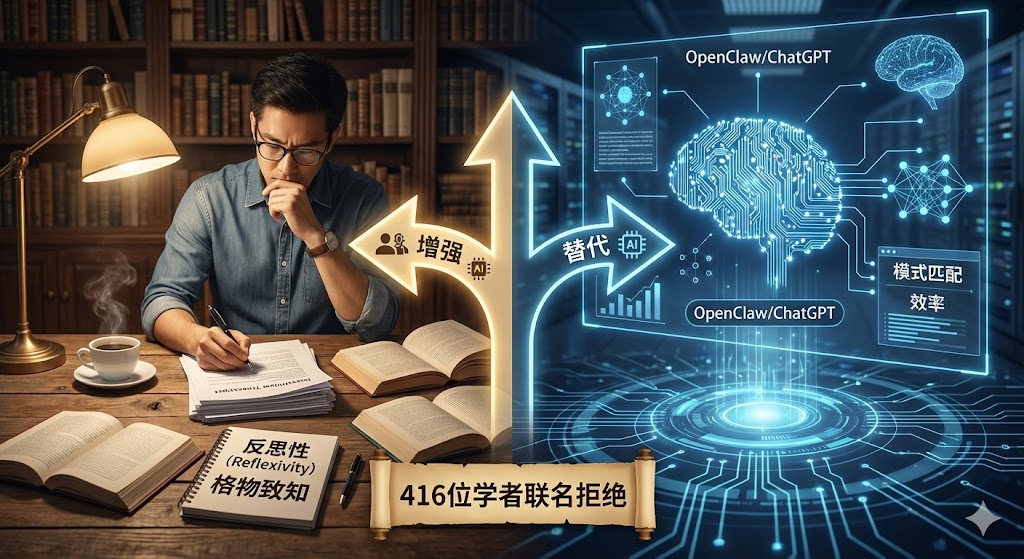

中国古代哲学强调“格物致知”——通过对事物的深入观察来获得知识。质性研究的精髓也在于此:研究者深入田野,与被研究者建立信任,在数据中浸泡,最终“涌现”出理论洞见。这个过程,古人称之为“工夫”,今人称之为“反思性”(reflexivity)。

生成式AI的工作原理却截然不同。它基于海量训练数据的统计模式进行预测,本质上是“依样画葫芦”。当我们让ChatGPT分析访谈数据时,它并非真正“理解”受访者的生活世界,而是在匹配它见过的类似文本模式。用古人的话说,这是“不知其然,只知其然”。

这种认识论差异带来的影响是深远的。Journal of Medical Internet Research的实证研究显示,使用ChatGPT进行扎根理论分析,可以将原本需要三周的编码工作压缩到一天完成。效率提升是惊人的,但代价呢?研究者与数据的“深度对话”变成了“快速匹配”,那种在数据中反复沉浸才能获得的顿悟,还会出现吗?

四百一十六位学者的联名反对

2025年初,由主题分析法权威Virginia Braun和Victoria Clarke领衔的416位质性研究学者,在顶级期刊《Qualitative Inquiry》发表了一份措辞严厉的联合声明。他们的核心观点是:只有人类能够进行反身性质性分析工作,在反身性质性分析的所有阶段使用AI都是不恰当的。

这份声明不是保守主义的固步自封,而是对质性研究哲学根基的捍卫。声明指出,反思性分析要求研究者将自己作为研究工具,不断审视自己的立场、偏见和权力位置如何影响研究过程。AI没有“自我”,没有社会位置,没有文化背景,它如何进行反思?

然而同样在2025年,斯坦福大学的AI Index Report显示,使用AI辅助的质性研究论文发表数量增长了340%。矛盾吗?不,这恰恰说明学术界正在经历一场深刻的分裂与重组。

两条岔路:增强还是替代?

目前的学术辩论正在形成两个阵营。“拒绝派”以Braun、Clarke等人为代表,认为AI即使只用于初步编码,也会从根本上改变研究的性质,将建构主义的质性研究推回实证主义的老路。

“整合派”则认为AI是工具,关键看怎么用。他们强调“人在回路”(human-in-the-loop)模式:AI负责繁重的初步编码(类似于图书馆员充当数据科学家的工作,先期对于处理加工数据的脏活累活都在这里完成,但没有经验、不了解技术能力、不能够与充满洞察和假设的社会科学研究者进行合作也是不行的),研究者保留最终的解释权和判断权。这种立场听起来很中庸,但实践中面临微妙的挑战——当AI已经提供了一套看似合理的编码方案,研究者还有多大动力去推翻重来?

庖丁解牛的故事告诉我们,技艺的精进来自反复的实践。如果初学者一开始就依赖AI完成编码,他们还能培养出那种“游刃有余”的分析直觉吗?这不是技术恐惧,而是对方法论传承的深层担忧。

温故而知新:重新审视质性研究的价值

在AI的冲击下,我们反而需要更清晰地回答一个根本问题:质性研究的独特价值到底是什么?

答案不是“样本小”或“不能统计”这些弱点,而是对意义的理解、对情境的敏感、对权力的批判。AI可以识别文本模式,但很难理解一个受访者沉默背后的创伤;AI可以统计关键词频率,但目前还无法感知一个社区的权力结构;AI可以生成流畅的报告,但无法对不公正表达出感同身受的愤怒。

质性研究是一种人文主义的知识生产方式,它的核心不是效率,而是深度。当我们拥抱AI时,需要时刻警醒:我们是在用技术增强人的能力,还是在用技术替代人的思考?

给研究者的建议

作为正在尝试采用AI研究方法的你,不必在“全盘接受”和“全盘拒绝”之间做选择。更重要的是培养批判性的AI素养:

- 先学会手工编码。只有掌握了传统技艺,才能判断AI的输出质量。

- 保持反思性日志。无论是否使用AI,都要记录自己的思考过程、困惑和顿悟。

- 关注认识论。每次使用AI前,问问自己:这个工具的使用,会改变我研究的哲学基础吗?

- 寻找人类导师。AI可以回答技术问题,但无法传授学术品味和伦理判断。

延伸思考

- 如果AI能在一天内完成原本需要三周的编码工作,质性研究者应该如何重新分配节省下来的时间?

- 当你的论文审稿人质疑:“你怎么证明这些主题不是AI生成的?”你会如何回应?

- 五年后,方法论教材中关于“编码”的章节会如何改写?

留下评论