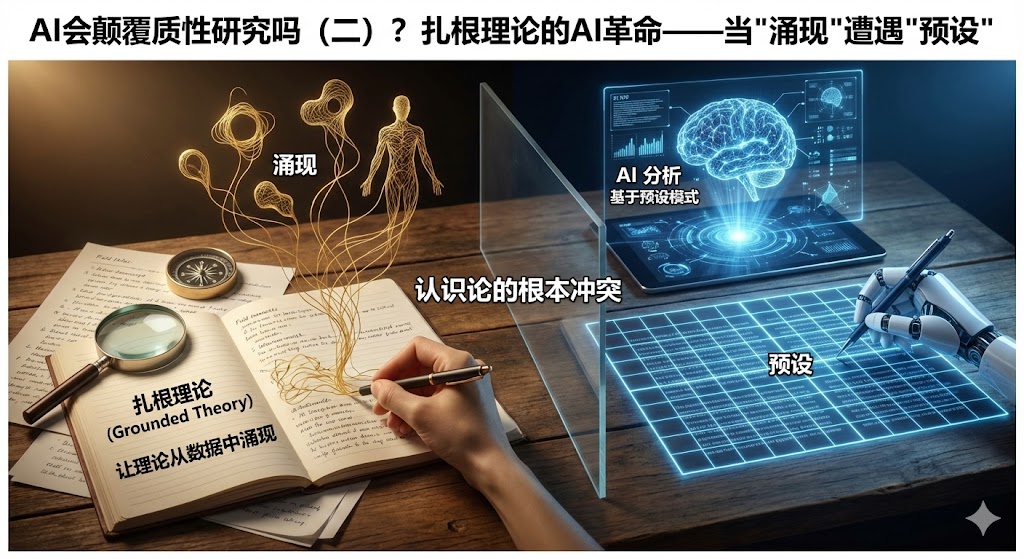

第二篇:扎根理论的AI革命——当“涌现”遭遇“预设”

“让理论从数据中涌现,而非强行套用既有框架。”这是扎根理论(Grounded Theory)创始人Barney Glaser和Anselm Strauss在1967年写下的核心箴言。半个多世纪以来,这句话被无数质性研究者奉为圭臬。然而今天,当我们让ChatGPT分析访谈数据时,我们还能说理论是“涌现”的吗?

从芝加哥大学的田野到算法的“田野”

扎根理论诞生于20世纪60年代的美国社会学界。当时,芝加哥学派的研究者们走进街头、医院、工厂,用参与观察和深度访谈的方式研究真实的社会生活。Glaser和Strauss在对临终关怀的研究中发展出一套系统的方法:不预设理论框架,而是在数据中反复比较,逐步抽象,最终让理论“自然而然地”涌现出来。

这个过程就像淘金——在大量的泥沙(原始数据)中,通过反复淘洗(持续比较),最终提炼出黄金(理论)。古人说“水落石出”,扎根理论追求的正是这种“去粗取精、去伪存真”的境界。

然而AI的“田野”是什么?是海量的互联网文本。当我们让ChatGPT分析关于“留守儿童心理健康”的访谈时,它调用的是训练数据中所有与“儿童”“心理”“健康”相关的模式。这些模式来自新闻报道、学术论文、社交媒体,甚至包括虚构故事。它给出的编码,本质上是对既有模式的再现,而非从当前数据的涌现。

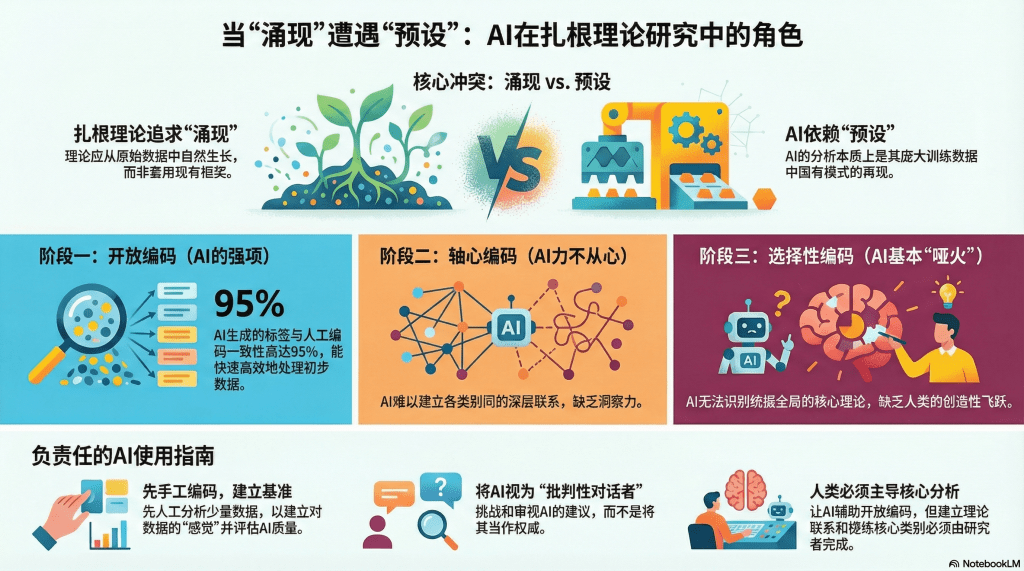

三阶段编码:AI能做什么,不能做什么?

扎根理论有一套经典的三阶段编码程序:开放编码(打碎数据,逐行标注)、轴心编码(建立类别间的联系)、选择性编码(提炼核心类别)。AI在每个阶段的表现截然不同。

开放编码是AI的强项。2025年发表于《Journal of Medical Internet Research》的研究显示,ChatGPT在开放编码阶段生成的节点数量(274个)与人工编码(289个)接近,句子层面的一致性高达95%。换句话说,如果任务只是“给每一段话打标签”,AI做得又快又好。

但进入轴心编码,AI就开始“力不从心”了。轴心编码要求研究者在各个类别之间建立有意义的联系,识别因果关系、背景条件、行动策略等。这需要对研究现象的深度理解和理论敏感性。研究发现,AI生成的轴心编码往往停留在表面的逻辑关联,缺乏洞察力。

到了选择性编码——识别能够统摄所有类别的“核心类别”(core category),AI基本“哑火”。因为这一步需要研究者的理论判断和创造性飞跃,而AI没有真正的判断力,只有模式匹配。

这让我想起《庄子》中的“庖丁解牛”。庖丁说他解牛时“以神遇而不以目视”,靠的是对牛的身体结构的深刻理解,而非表面的观察。扎根理论也是如此——核心类别的识别,需要的是那种“神遇”的顿悟,而非AI的“目视”。

“涌现性”遭遇“预设模式”:认识论的根本冲突

扎根理论最核心的哲学承诺是理论的涌现性(emergence)——理论应该从数据中自然而然地生长出来,而非研究者预先带入的(然而却也是研究者后来“洞察”和“发现”的)。Glaser曾尖锐批评某些研究者“forcing”(强行套用)理论框架。

但AI的工作原理恰恰是基于“预设模式”。它的每一次输出,都是基于训练数据中的统计规律。用哲学术语说,AI是演绎的(deductive),而扎根理论要求归纳的(inductive)思维(目前大模型如何从关联关系进化到因果关系,已经有很多研究,但尚未取得突破)。这种认识论上的不兼容,是无法通过改进提示词(prompt)来解决的。

有学者提出,可以让AI扮演“第二编码员”的角色,与人类编码员进行“对话”。这听起来不错,但实践中存在微妙的权力动态:当AI已经提供了一套看似合理的编码方案,人类研究者需要具备足够的负责任态度、独立性和自信心才能推翻重来。尤其对于缺乏经验的研究生,AI的建议很容易变成无形的“理论预设”。

Kathy Charmaz的建构主义扎根理论怎么说?

扎根理论发展到今天,已经形成了多个流派。其中影响最大的是Kathy Charmaz在2006年提出的建构主义扎根理论(Constructivist GT)。与Glaser的经典扎根理论强调“发现”理论不同,Charmaz认为理论是研究者与参与者共同建构的。

从这个视角,表面上看起来似乎给了AI一定的话语空间,但AI的参与也带来了更深层的问题:AI作为非人类的“共同建构者”,它的参与如何改变了知识的性质?Charmaz强调研究者需要对自己的立场保持反思,但AI没有“立场”,它如何反思?当我们说“AI辅助生成的理论”时,这个理论到底是谁的建构?

遗憾的是,Charmaz于2020年去世,未能亲自评论AI时代的扎根理论。但她的核心观点——知识是具身的、情境的、关系性的——暗示了对AI介入的深刻质疑。

给使用AI做扎根理论的实用建议

如果你确实要使用AI辅助扎根理论分析,以下是一些负责任的做法:

- 先手工编码一部分数据

选择3-5份访谈,完全用传统方法编码。这能帮你建立对数据的“感觉”,也为后续评估AI输出质量提供基准。

- 把AI当作“批判性对话者”而非“权威”

AI给出编码后,问自己:这个编码捕捉到了受访者话语背后的意义吗?它是否过于表面?是否有文化偏见?

- 保留完整的分析痕迹

记录你使用的提示词、AI的原始输出、你的修改理由。这不仅是学术诚信的要求,也帮助你保持反思性。

- 轴心编码和选择性编码必须由你主导

可以用AI快速完成开放编码,但建立类别间联系、提炼核心类别,必须是你深度思考的结果。

- 成员检验(member checking)时披露AI的使用

如果你把分析结果返回给受访者核实,应该告诉他们:“我使用了AI辅助初步编码,但所有解释都是我的判断。”这是对参与者的尊重。

延伸思考

- 如果未来AI能够真正“理解”人类的生活世界(比如通过AGI),扎根理论还需要人类研究者吗?

- 你认为Glaser会如何评价AI辅助的扎根理论?Charmaz又会怎么说?

- 有没有可能发展出一种“AI原生”的扎根理论方法论,而非简单地把AI套用到传统框架中?

留下评论