第八篇:信不信由你——质性研究标准的AI时代重建

答辩现场,社会学系的博士生小李紧张地站在讲台上。一位评委教授翻看着论文,突然抬起头问:“你在方法部分说使用了主题分析法,但没有提到是否使用AI辅助。请问,你的编码完全由人工完成吗?”

小李愣住了。她确实用ChatGPT做过初步编码,但后来全部人工审查和修改过。这算“使用AI”吗?如果算,她应该怎么报告?如果不算,万一被查出来,会不会被质疑学术诚信?

教授继续问:“即使你声称人工审查过,我们如何确认主题不是AI生成的?你能提供足够的‘质量证据’吗?”

小李的困境,折射出整个质性研究界正在经历的信度和效度危机。

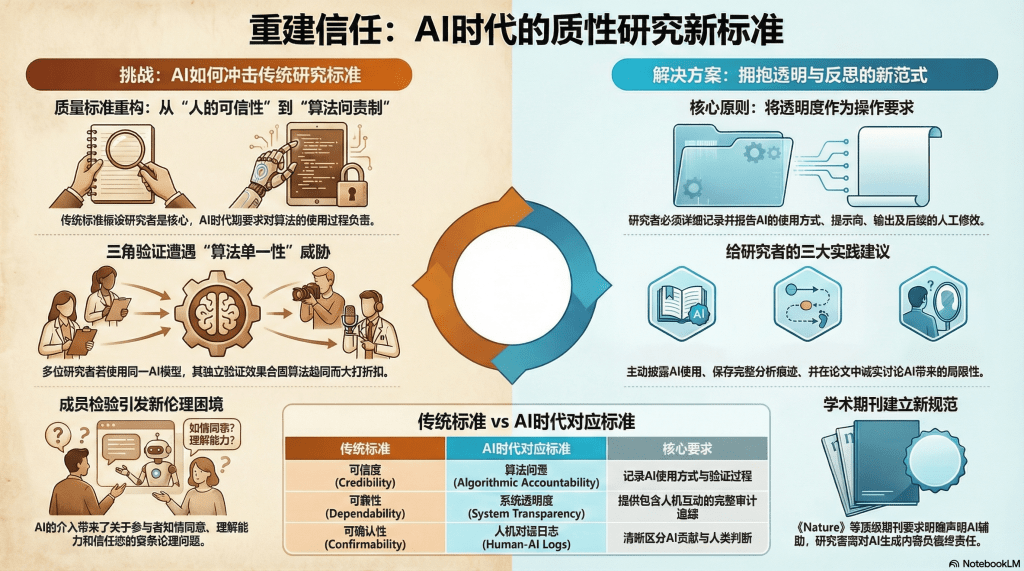

从“可信性”到“算法问责”:Lincoln & Guba标准的重构

1985年,Lincoln和Guba在《自然主义探究》中提出质性研究的四项可信性(trustworthiness)标准,这套框架影响了整整四十年:

- 可信度(credibility):研究发现可信吗?

- 可迁移性(transferability):发现能推广到其他情境吗?

- 可靠性(dependability):研究过程稳定可追溯吗?

- 可确认性(confirmability):发现确实来自数据而非研究者想象吗?

这套标准建立在一个假设上:研究者是核心行动者,数据分析由人类完成。但当AI介入后,这些标准还适用吗?

2025年有学者提出AI时代的平行标准:

| 传统标准 | AI时代对应标准 | 核心要求 |

| 可信度 | 算法问责 | 记录AI使用方式、提示词、输出 |

| 可迁移性 | 情境嵌入日志 | 保留人类研究者的情境理解 |

| 可靠性 | 系统透明度 | 审计追踪包含人机互动 |

| 可确认性 | 人机对话日志 | 区分AI贡献和人类判断 |

核心转变是:透明度从原则上升为操作性要求。不仅要说“用了AI”,还要说明用在哪个环节、如何提示、如何验证、如何修改。

三角验证遭遇“算法单一性”

三角验证(triangulation)是质性研究最重要的质量保证策略:通过多种数据源、多种方法、多位研究者的交叉印证,增强发现的可信度。

但AI带来了新问题:算法单一性。如果三位研究者都使用ChatGPT做初步编码,这还算“研究者三角验证”吗?表面上是三个人,实质上可能都受到同一个AI模型的影响。

更微妙的是:当人类编码和AI编码出现冲突时,研究者往往会倾向于“对齐”AI的结果——因为AI看起来“更系统”“更客观”。这种隐性压力可能损害真正的三角验证。

解决方案?有学者提出“后三角验证”(Post-Triangulation)框架:整合传统三角验证、结晶化(crystallization)与算法分析,AI作为“算法协同分析者”参与人类-数据-算法的三元互动。关键是保持三者的张力,而非趋同。

成员检验的新伦理困境

成员检验(member checking)——将分析结果返回给参与者验证——在AI时代面临新的伦理问题。

场景一:知情权问题

研究者:“这是我对您访谈的分析,请看看是否准确。”

参与者:“好的,很准确。”

[参与者不知道分析主要由AI完成]

这构成了知情同意的瑕疵吗?

场景二:理解能力问题

研究者:“我使用了AI辅助分析,就是说我把您的访谈输入ChatGPT……”

参与者:“啥是ChatGPT?我的话被弄到哪儿去了?安全吗?”

如何向受教育程度低、技术素养有限的参与者解释AI?

场景三:信任危机

参与者:“我以为是您在认真听我说话,原来是给机器分析的?那您还来采访我干什么?”

这种“被背叛感”如何应对?

有学者建议:事前透明+事后验证的双重知情同意模式:采访前告知可能使用AI,分析后再次确认并征求意见。但这增加了参与者负担,也可能影响他们的讲述。

编码者间信度的“降维”

传统上,两个编码者达到κ>0.6被视为可接受的编码者间信度(Inter-coder Reliability)。但2024年的对比研究显示:

| 编码者对 | 归纳分析ICR | 演绎分析ICR |

| 人-人 | 0.75 | 0.72 |

| 人-ChatGPT | 0.47 | 0.37 |

| 人-Bard | 0.37 | 0.36 |

| ChatGPT-Bard | 0.37 | 0.47 |

人-AI的一致性显著低于人-人。更有趣的是,不同AI之间的一致性也很低。这说明什么?

AI之间的差异不是随机误差,而是系统性的“算法个性”。ChatGPT、Claude、Gemini使用不同的训练数据、参数设置,导致对同一材料的“理解”不同。

这对信度概念提出挑战:传统ICR假设两个合格编码者应该大体一致,但如果AI是“编码者”之一,低一致性是工具缺陷还是“视角多元”?

学术期刊的新政策:从宽容到严格

2024-2025年,主要学术期刊纷纷更新AI使用政策。

Nature系列:要求在方法或致谢部分声明AI协助;AI不能作为共同作者;研究者对AI输出承担最终责任。

SAGE出版社:联合社论呼吁更新知情同意表,包含AI使用条款;要求研究者说明AI使用的伦理考量;对不同意AI处理的参与者,数据应被排除。

APA(美国心理学会):要求披露AI工具名称、版本、使用的具体任务、人类验证程度。

趋势很清楚:从“可以不说”到“必须说清”。但现有报告框架(COREQ,SRQR)都是AI出现前制定的,未要求披露提示词、模型参数、人机迭代细节。

Jones(2025)提出的TROUT-AI矩阵试图填补这个空白,要求报告:

- Tools:使用的AI工具

- Rationale:使用AI的理由

- Outputs:AI的原始输出

- Updates:人类的修改内容

- Transparency:整个过程的审计追踪

一个反思:质量标准的本质是什么?

在AI的冲击下,我们反而需要回答一个根本问题:质性研究的质量标准,保护的到底是什么?

是保护“人工劳动”吗?不是。手工编码本身不是目的。

是保护“可重复性”吗?也不完全是。质性研究本来就强调研究者的独特视角。

真正需要保护的,是研究的诚实性、反思性和伦理性:

- 诚实性:如实报告研究过程,包括AI的使用

- 反思性:持续审视自己(和AI)的假设和偏见

- 伦理性:尊重参与者,对知识生产负责

从这个角度看,AI的使用本身不是问题,隐瞒使用或盲目信任输出才是问题。

给准备发表的建议

- 主动而详细地披露AI使用

与其等审稿人质疑,不如主动在方法部分单设一节“AI工具使用”,说明工具、用途、验证过程。

- 保存完整的分析痕迹

每次AI分析都保存:输入的提示词、原始输出、你的修改及理由。这既是学术诚信的证据,也是反思的材料。

- 在局限性部分讨论AI的影响

诚实讨论AI可能带来的偏见、遗漏和局限。这反而增加可信度。

- 提供“深度案例”证明人类诠释

选择1-2个案例,展示你如何从AI的表面编码深化到诠释性理解。这能有力证明人类研究者的贡献。

- 学习新兴的报告标准

关注TROUT-AI、EQUATOR Network等新标准的发展,让你的报告与时俱进。

延伸思考

- 如果未来所有研究者都使用AI,质性研究的“多样性”会增加(因为AI的随机性)还是减少(因为算法趋同)?

- 十年后,质性研究的核心评价标准会是什么?会是“与AI的创造性对话能力”吗?

- 我们是否需要一个“质性研究AI使用伦理委员会”,就像生物医学研究的IRB那样?

留下评论