第九篇:象牙塔里的伦理困境——当数据遇见算法

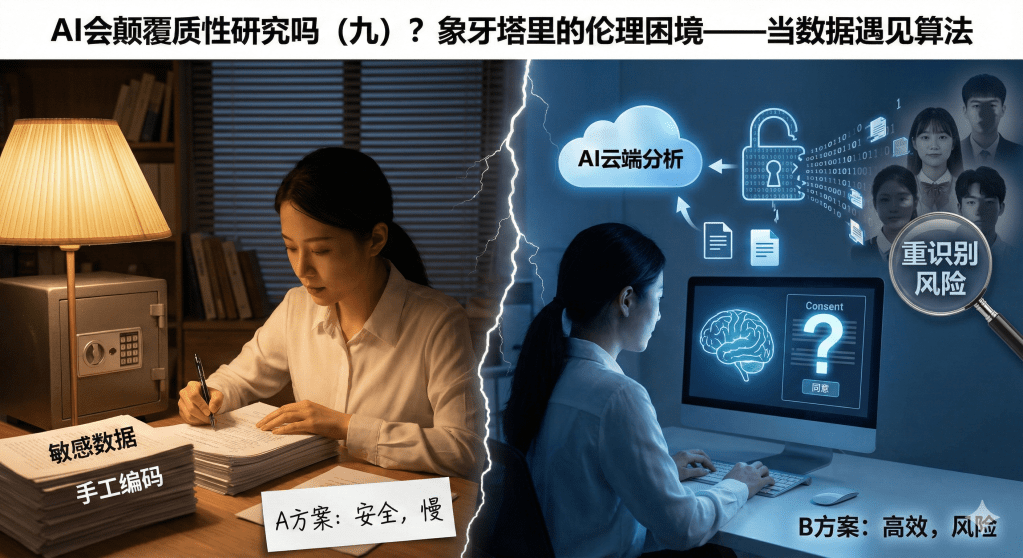

凌晨两点,教育学院的研究生小刘盯着电脑屏幕犹豫不决。她手上有三十份关于校园霸凌受害者的深度访谈,详细记录了学生们的创伤经历。现在,她面临一个选择:

A方案:像往常一样,手工编码,三个月完成分析。数据完全在本地,安全。

B方案:使用ChatGPT辅助编码,一周完成初稿。但需要上传访谈文本到OpenAI的服务器。

隐私协议书上写着:“我们保证您的个人信息不会泄露给第三方。”但协议是在一年前签的,那时还没有AI。现在把学生的创伤叙事上传到商业AI平台,算不算违反承诺?

更让她纠结的是,受访学生都是未成年人。他们的监护人签署了知情同意书,但那份同意书里根本没提到“人工智能”“数据上传”“云端分析”这些概念。

小刘的困境,是当前成千上万质性研究者共同面临的伦理困境。

知情同意的“代际落差”

知情同意(informed consent)是研究伦理的基石。但问题在于:知情同意不是一劳永逸的,而是基于当时的技术条件。

一个真实的案例:某社会学家2018年研究农民工的城市适应,收集了大量访谈。2024年,她想用这些历史数据做AI辅助的二次分析。但当年的知情同意书只说“数据用于学术研究”,根本没提AI。

她面临的选择:

- 重新联系受访者?许多人已经失联,即使找到也难以解释“什么是AI分析”

- 视为原知情同意覆盖?但受访者当初可能完全没想到数据会被这样使用

- 放弃使用旧数据?但这些宝贵的历史资料就此束之高阁

目前的学术共识倾向于:如果数据使用方式根本性改变(如从人工到AI),应该重新获得同意或至少通知参与者。但操作中困难重重。

2024年SAGE出版社的联合社论建议:新的知情同意书应明确包含AI使用条款,告知:

- 数据可能被AI系统处理

- 数据可能传输到第三方云服务

- 参与者有权选择不同意AI处理(其数据将被排除)

但这又带来新问题:如何向教育程度有限、技术素养不足的参与者解释AI?一位研究农村老人的学者说:“我给他们看知情同意书上的AI条款,他们的反应是‘啥是云?数据会飘到天上去吗?’”

数据隐私的“黑箱”风险

AI数据处理的最大问题是:不透明性。当你把访谈上传到ChatGPT,会发生什么?

官方政策说:OpenAI不会将你的数据用于训练模型(如果你使用API或付费版本)。

但实践中:

- 数据仍然经过OpenAI的服务器

- 可能被临时存储(日志、缓存)

- 员工或承包商可能在质量审查时看到

- 存在数据泄露风险(黑客攻击、系统漏洞)

2025年有研究发现:即使数据“去标识化”(删除姓名、地址等直接识别符),AI仍然可能通过叙事细节实现“重识别”(re-identification)。

比如,某访谈去标识化后是:“一位40岁女性,两个孩子,在某工厂工作,2020年因工伤维权……”看起来很匿名,但如果这是小县城唯一的工伤维权案,本地人一眼就能认出是谁。

更隐蔽的风险是“集合式识别”:单个数据点可能匿名,但当AI处理数千份类似数据,通过模式匹配和关联分析,可能推断出敏感信息。这是传统去标识化方法无法应对的。

缓解策略包括:

- 使用本地运行的LLM(如开源模型),数据不出本机

- 数据脱敏(generalization):不说“在富士康工作”,说“在电子制造业工作”

- 使用机构自建AI服务:一些大学开始提供校内AI平台,保证数据不外流

- 差分隐私技术:在数据中加入“噪音”,使个体无法被准确识别

“合成参与者”的伦理地位

一个更激进的现象是:AI生成的合成参与者。

研究者将真实访谈输入AI,让AI“扮演”这些受访者,研究者可以无限次地“追问”。比如,你可以问:“如果给你一百万,你会做出不同选择吗?”——这是当初访谈时没问的。

支持者说:这扩展了研究的可能性,不需要打扰参与者就能探索新问题。

批评者质疑:这个“合成参与者”到底是谁?

- 它不是真正的受访者(他们从未说过这些话)

- 它不是AI(AI只是根据训练数据模拟)

- 它是基于真实数据的虚拟人格

我们对虚拟人格有伦理义务吗?比如,如果AI生成的合成参与者“表达”了痛苦,我们应该在乎吗?

更现实的问题是:原始参与者知道自己被“克隆”了吗?即使数据匿名,让AI扮演你,是否仍然是对你尊严的侵犯?

目前这个领域几乎没有伦理共识,是一片“伦理荒原”。

边缘化声音的“算法过滤”

AI的偏见问题众所周知,但在质性研究中有独特的表现:边缘化群体的声音可能被系统性误读或删除。

口音偏见:OpenAI的Whisper语音转录工具对非母语口音的错误率翻倍。一位研究移民的学者发现,她的东南亚受访者的访谈转录满是错误,导致AI后续分析也偏离。

方言偏见:ChatGPT训练数据以标准普通话为主,对地方方言、网络黑话、亚文化行话理解有限。研究底层社群、青年亚文化时,AI常常“听不懂”。

文化偏见:某日本研究发现,ChatGPT对“难以回答”“命运”等需要文化—情感解释的词汇,理解力仅30%。西方训练数据的主导性,导致非西方文化经验被“误译”。

结果是:使用AI可能无意中强化了学术知识生产中的霸权结构,让主流声音更清晰,边缘声音更模糊。

学术诚信的“灰色地带”

另一个伦理困境是:多少AI使用算“作弊”?

- 场景一:你让ChatGPT转录录音。这算AI使用吗?

- 场景二:你让ChatGPT做初步编码,但每一条你都审查过。算吗?

- 场景三:你和ChatGPT“对话式分析”,它提问题,你回答,最后主题是对话的结果。算吗?

- 场景四:你遇到困惑,问ChatGPT“这段话可能是什么意思”,它的解释启发了你。算吗?

目前没有明确界限。有学者认为:只要AI触及了分析的核心环节(编码、诠释),就必须声明。但“触及”的程度如何界定?

更微妙的是“认知依赖”:当你知道随时可以求助AI,你还会深度思考吗?就像计算器让我们心算能力下降,AI会不会让我们的分析直觉退化?

这不只是个人问题,而是代际传承的危机。如果新一代研究者从未完整经历过“手工编码三个月”的“痛苦”,他们还能培养出那种“游刃有余”的质性直觉吗?

给伦理考量的建议

- 更新你的知情同意书

如果论文还在前期,现在就修改知情同意书,加入AI使用条款。给参与者真正的选择权。

- 采用“伦理优先于效率”原则

当隐私保护和分析效率冲突时,选前者。AI能让你快几周,但伦理瑕疵会伴随论文终生。

- 咨询你的IRB/伦理委员会

许多伦理委员会尚未更新AI指南,但你的咨询会推动他们思考这个问题。这本身就是贡献。

- 在论文中诚实讨论伦理两难

如果你面临伦理困境,不要隐藏,在论文中坦诚讨论你的考量和选择。这种反思性本身就是伦理责任的体现。

- 参与建立新规范

AI研究伦理是新领域,需要新一代研究者参与规范建设。你的声音很重要。

延伸思考

- 如果AI未来能完美模拟一个已故亲人的访谈风格,研究者“采访”这个AI亲人,这在伦理上可接受吗?

- 当AI成为知识生产的主要工具,会不会加剧南北学术鸿沟?(发达国家有先进AI,发展中国家没有)

- 我们是否需要一种“数据尊严”(data dignity)的概念,保护数据不被AI以某些方式使用,即使数据已经去标识化?

留下评论