第十篇:做一个塑造未来的人文学者

毕业答辩结束,社会学系的博士生阿华走出会议室,长舒一口气。五年的博士生涯,她经历了质性研究从“纯手工”到“人机协同”的转变。

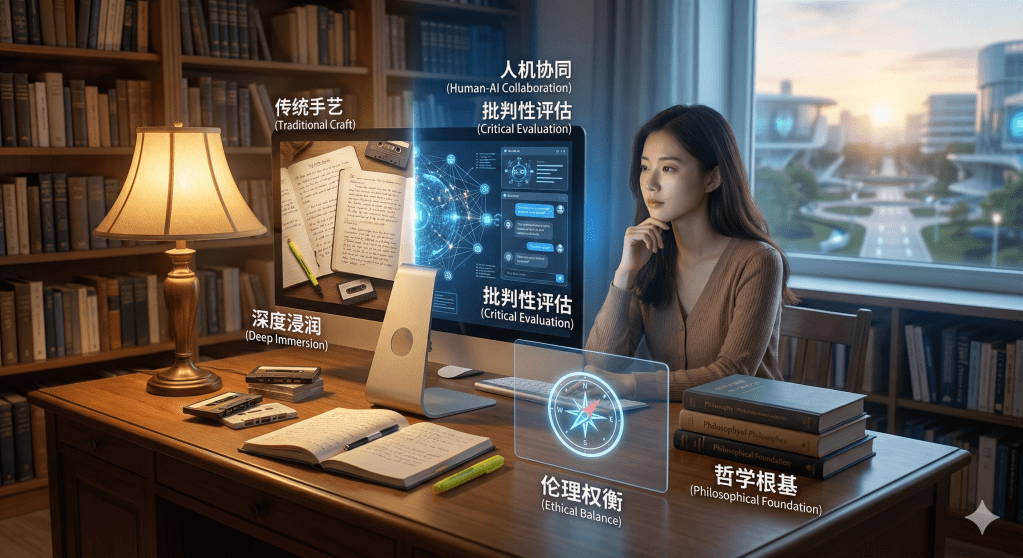

回想起来,转折点发生在三年前。那时,她还在用荧光笔在打印的访谈稿上做开放编码,一个字一个字地读,一段一段地标注。那种与数据的亲密接触,那种在文字中沉浸到忘记时间的体验,她至今怀念。

后来,师兄推荐她试试ChatGPT。刚开始她抗拒,觉得这是“偷懒”,是对学术的“不尊重”。但截稿日期逼近,导师催促,她妥协了。第一次把访谈上传,看着AI在几分钟内生成初步编码,她的感受很复杂:既惊叹于效率,又隐隐觉得失去了什么。

五年后的今天,她已经能够熟练地“驾驭”AI——知道什么任务可以交给它,什么必须自己做;知道如何设计提示词,如何批判性评估输出;知道在伦理和效率之间如何权衡。

但她也意识到:自己是“过渡一代”——既经历过传统训练,又掌握了新工具。未来的学生,会是什么样?

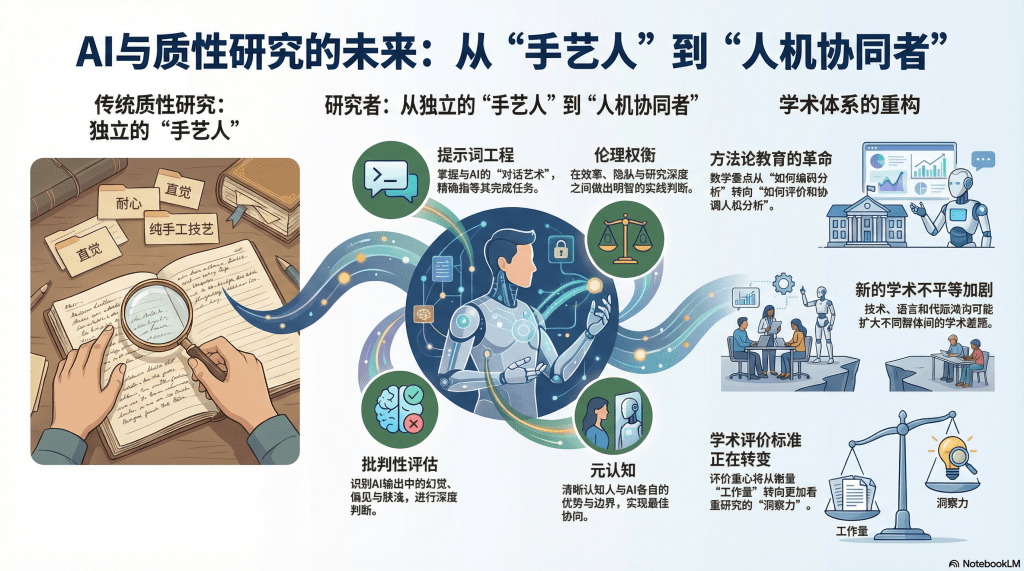

新素养:从“手艺人”到“协同者”

古人讲“文章千古事,得失寸心知”。质性研究长期以来被视为一种“手艺”(craft),需要师傅带徒弟,在实践中反复磨练。

AI时代,这种手艺会消失吗?不会,但会转型。

研究者的角色正在从“独立手艺人”转向“人机协同者”。新的核心能力包括:

- 提示词工程(Prompt Engineering)

这不是简单的输入指令,而是一种新的“对话艺术”。好的提示词需要:

- 清晰的任务界定

- 充分的背景信息

- 适当的理论框架

- 明确的输出格式

- 关键的限制条件

举例:不好的提示词——“分析这段访谈”

- 批判性评估能力

AI会“幻觉”,会偏见,会表面化。研究者需要培养辨别力:

- 幻觉检测:AI是否编造了受访者没说的话?

- 偏见识别:AI的解释是否带有文化、性别、阶级偏见?

- 深度判断:AI的分析停留在表面还是触及本质?

这需要深厚的学科素养和理论敏感性。AI降低了技术门槛,但提高了理论门槛。

- 伦理权衡能力

每次使用AI都需要权衡:

- 效率vs隐私?

- 规模vs深度?

- 创新vs传统?

这种权衡没有标准答案,需要研究者的实践智慧(phronesis)——亚里士多德说的那种在具体情境中做出恰当判断的能力。

- “元认知”——认识你和AI的边界

优秀的协同者知道:

- 我在什么任务上比AI强?(深度诠释、情境理解、伦理判断)

- AI在什么任务上比我强?(大规模模式识别、跨案例比较、文献整合)

- 什么任务需要人机各半?(初步编码由AI,审查由我;结构分析由AI,意义诠释由我)

这种自我认知,恰恰是AI无法拥有的。

课程重构:方法论教育的革命

想象一下,五年后的“社会研究方法”课程会是什么样?

传统模块(仍然核心):

- 认识论与本体论

- 研究设计

- 访谈技巧

- 田野工作伦理

- 手工编码(作为基础训练,就像学画画要先学素描)

新增模块:

- AI辅助质性分析:工具、方法、伦理

- 提示词工程工作坊

- 人机协同研究设计

- AI输出的批判性评估

- 算法偏见识别与缓解

颠覆性变化:

- 从“如何编码”到“如何评价编码”

- 从“如何分析”到“如何协调人机分析”

- 从“如何保证质量”到“如何保证透明度”

最重要的补充:哲学课

当技术快速变化,不变的只有哲学根基。学生需要更深入地理解:

- 什么是“理解”?(诠释学)

- 知识如何建构?(建构主义)

- 权力如何运作?(批判理论)

- 研究者的责任是什么?(研究伦理)

只有从哲学中寻找根基,才不会在技术潮流中迷失方向。

学术生态的重组

AI不只改变个人,也在重组整个学术生态。

赢家与输家

- 赢家:掌握AI但保持批判性的研究者;有独特理论视角的研究者;能做深度诠释的研究者

- 输家:只会“纯手工”的保守者;盲目依赖AI的偷懒者;缺乏理论深度的“技术工”

新的不平等

- 技术鸿沟:发达国家vs发展中国家;名校vs普通院校;有经费vs没经费

- 语言鸿沟:英语母语者vs非英语者(因为AI主要训练数据是英语)

- 代际鸿沟:数字原住民vs数字移民

这些不平等需要学术共同体的集体应对,而非个人竞争。

期刊与评价体系的调整

- 越来越多期刊要求AI使用披露

- 可能出现“AI使用分级”制度(类似电影分级):无AI、辅助性AI、核心使用AI

- 评价标准可能从“工作量”转向“洞察力”(因为AI降低了前者的意义)

君子和而不同:方法论立场的多元共存

儒家讲“君子和而不同”。在AI时代,质性研究界也需要这种智慧:承认不同立场的合理性,在分歧中寻求对话。

拒绝派有其道理:

- 反思性是质性研究的灵魂,AI无法替代

- 过早依赖AI会损害新一代的分析直觉

- 效率不应成为压倒一切的标准

整合派也有其合理性:

- 质性研究不应是精英特权,AI的普及化具有民主意义

- 节省下来的时间可以用于更深的诠释

- 拒绝工具本身是一种特权(有时间、有资源的人才能拒绝)

关键是:各派应该开诚布公地讨论彼此的关切,而非相互攻击。

也许未来会形成一种“方法论生态系统”:

- 纯手工质性研究(追求极致深度,小样本)

- 轻度AI辅助研究(AI做初步整理,人类主导分析)

- 重度AI辅助研究(人机深度协同,大样本)

- AI原生研究(探索全新的人机协作范式)

没有哪一种绝对正确,关键是明确你的选择,并为你的选择负责。

致AI时代的社会学者:在变革中保持初心

最后,我想对正在读这个系列的你说:

你生逢其时,也面临挑战。你们这一代,将见证质性研究方法论的深刻转型。这个过程会混乱,会充满争议,但也充满可能性。

几点建议:

- 保持学习的谦卑

技术在变,理论在变,规范在变。保持开放的心态,终身学习。

- 守住学术的初心

无论工具如何变化,质性研究的初心不变:理解人类经验,揭示社会真相,追求公平正义。不要让工具的便利性,掩盖了学术的使命。

- 发展批判性思维

对AI保持批判,对传统也保持批判。不盲从权威,不盲信技术,用自己的头脑思考。

- 培养伦理敏感性

每个技术选择都是伦理选择。问自己:这样做,对参与者公平吗?对知识诚实吗?对社会负责吗?

- 建立学术共同体

不要孤军奋战。与同学、导师、同行建立真诚的对话,在集体智慧中成长。

- 记住:你是“人”,不是“用户”

AI公司希望你成为他们产品的“用户”,但你首先是一个有批判意识的学者,一个有社会责任的知识分子。工具为人服务,而非人为工具服务。

结语:未来的质性研究

《易经》说:“穷则变,变则通,通则久。”质性研究正在经历“穷”的阶段——传统方法遭遇挑战,新工具带来困惑。但这恰恰是“变”的契机。

未来的质性研究,可能是这样的:人类研究者专注于那些需要深度诠释、情境理解和批判意识的核心任务,AI则处理繁重的机械性工作。人机各司其职,相得益彰。

但这个未来不会自动到来,需要这一代学者——包括正在读这篇文章的你——共同创造。

愿你在变革的时代,既能拥抱新工具,又不失学术的灵魂。

愿你成为那种研究者:会用AI,但不依赖AI;追求效率,但不牺牲深度;拥抱未来,但不忘初心。

道阻且长,行则将至。共勉。

〈系列完〉

留下评论