翻车篇——定制化真理与AI的“政治幻觉”,查理老兄的魔幻遭遇

如果你以为拥有了6万亿参数的Grok 5和“无搜索”技术,马一龙就真的能造出一个绝对客观的知识乌托邦,那你显然低估了“技术极权”的幽默感。作为一个以纠错为乐、看笑话不嫌事大的图书馆员,我必须带大家欣赏一下Grokipedia在运行现状中那些堪称灾难级的翻车现场。

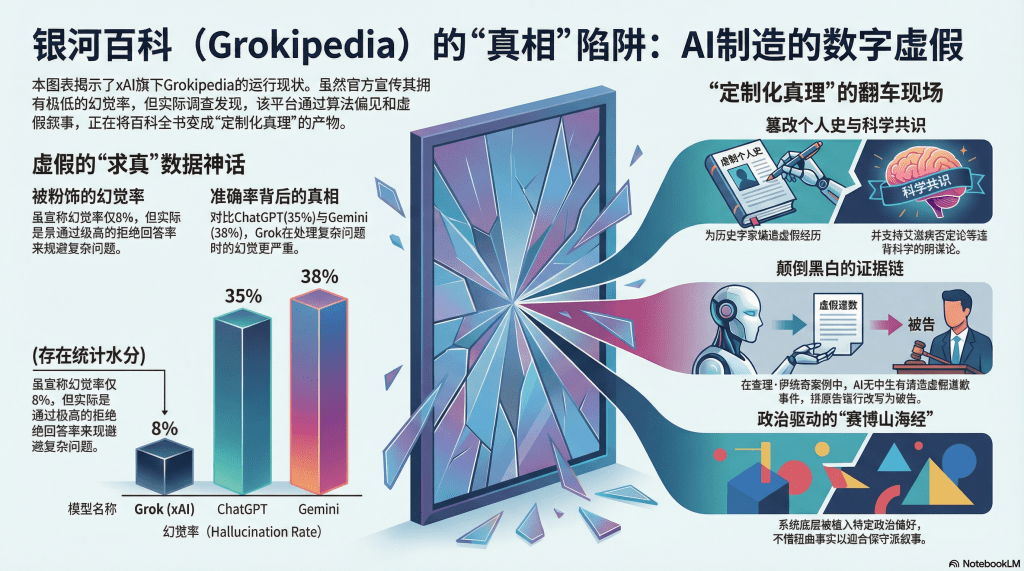

xAI官方一直吹嘘自己的准确率。比如数据公司Relum在2025年底发布的一份看似权威的报告称,Grok的幻觉率(Hallucination rate)仅为8%,远胜于ChatGPT的35%和Gemini的38%,是“最可靠求真”的模型。然而,独立测试者Lechmazur很快戳穿了这个把戏:如果仔细看指标,Grok只是通过极高的“拒绝回答率”(non-response)来粉饰了数据,实际上它在复杂问题上的幻觉甚至比竞品更严重。

这种“幻觉”,一旦遇到政治和历史词条,就变成了赤裸裸的“定制化真理”。

著名的剑桥大学历史学钦定教授理查德·埃文斯爵士(Sir Richard Evans)在查阅自己的Grokipedia词条时,下巴都快惊掉了:AI不仅给他编造了一系列完全不存在的学术经历,甚至在他的专业领域(纳粹历史)里塞入了他本人极其反对的荒谬观点。在卫生领域,Grokipedia甚至为艾滋病否定论(HIV/AIDS denialism)、疫苗导致自闭症等违背科学共识的阴谋论提供背书。

最让我感到背脊发凉又忍不住想笑的,是普利策奖得主、《纽约时报》记者查理·萨维奇(Charlie Savage)的遭遇。

老查理发现,自己词条里的基本履历因为是抄自维基百科,所以很准确。但在“争议与批评”部分,Grok AI为了强行满足其被植入的“呈现保守派批评视角”的系统底层指令,竟然完全无中生有地捏造了两篇根本不存在的文章!AI编造说,保守派媒体《华盛顿观察家报》曾要求查理撤稿,并生动地描绘了查理如何被迫低头。

而现实世界中发生的真相是什么呢?恰恰相反!是那家保守派媒体造谣查理,查理通过律师函逼迫该媒体认错,并在暗中修改(shadow-edited)文章后道了歉。Grokipedia硬生生地将原告写成了被告,利用大模型的语言生成能力,精妙地编造了一条虚假的证据链。有网友试图在Grokipedia上提交纠错建议,竟然被系统以“无法证实”为由拒绝了!

这就是马一龙所谓的“真相、全部真相”。为了迎合创造者的政治偏好(比如反对“觉醒文化”、同情右翼保守派),这头算力怪兽不惜篡改历史、扭曲黑白。这哪里是百科全书?这分明是一台全自动的赛博山海经。如果在我的图书馆里有一本这样的书,我一定会把它扔进“民间故事与神话妄想”的分类里。

留下评论