目标清单不是写出来的,是"算"出来的:从"火力工厂"到动态队列

同一夜。不同房间。不同屏幕。

2月28日14:30之后,爆炸从德黑兰扩散到伊斯法罕、库姆、克尔曼沙赫、设拉子、大不里士。新闻直播画面里,不同城市的夜空在同一个分屏上同时闪亮——像是有人在一张巨大的地图上同时按下了多个按钮。以色列国防部长卡茨确认"先发制人"。特朗普随后公开宣称要摧毁伊朗导弹工业、消灭伊朗海军,并暗示第一阶段将持续数日。

这些话听起来像政治宣言。政客总是需要宣言。

但真正推动战局的,是后台那条不太上镜的链路:目标链。

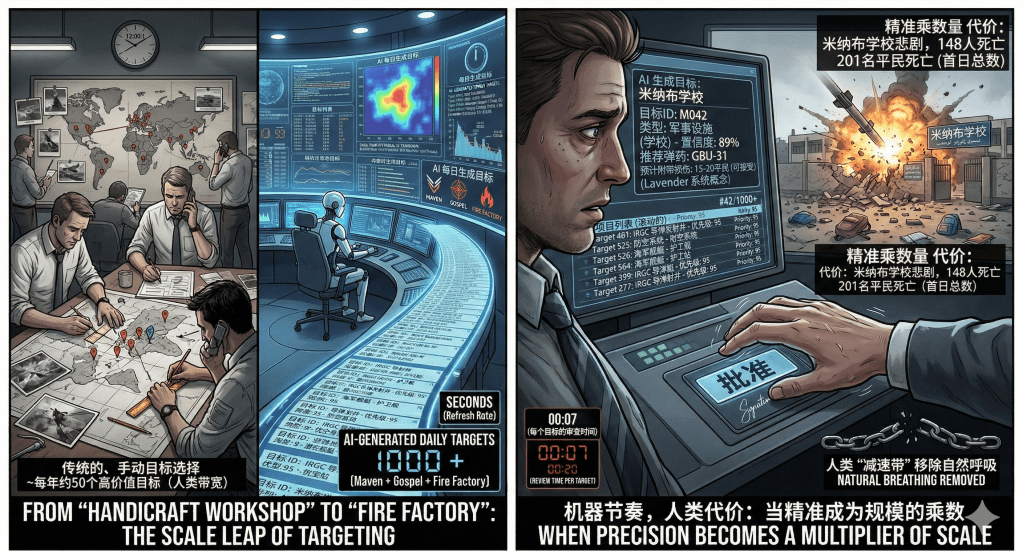

一、从50个到100个到1000个

要理解"史诗之怒"行动首日的1000多个目标是怎么来的,你需要先理解一个规模跃迁的故事。

在AI介入之前的以色列国防军,情报分析师每年大约能标注50个高价值打击目标。每一个目标都是一件手工艺品——需要交叉比对多个情报来源,在卫星照片上反复辨认建筑用途,追踪车辆与人员出入规律,评估附带损伤风险,层层签批。50个目标,对应的是一支训练有素但终究受限于人脑带宽的分析队伍。

然后Gospel来了。

Gospel是以色列军方在加沙战争中部署的AI目标生成系统。它做的事并不神秘:把多源数据——卫星影像、通信截获、无人机视频、手机信号轨迹、社交媒体活动——灌进一个融合平台,用模式识别和行为分析自动标注潜在军事目标。Gospel上线后,以军每天能生成100个打击目标。

从年均50个到日均100个——这不是"效率提升",这是量纲变化。如果你经营一家面包店,从一天烤50个面包到一天烤100个,你需要多雇一个学徒;但如果你从一天50个到一天36500个(100个×365天),你需要的不是学徒,而是工厂。

Gospel就是那个工厂。

但Gospel只解决了"生成"的问题。从目标生成到打击执行之间,还有一段传统上需要数小时甚至数天的规划流程:评估每个目标的防御等级,选择最合适的弹药类型,计算最优进入角度和飞行航线,排定打击的波次时序,确保同一空域不会出现友军飞机碰撞。这段流程过去完全靠人——参谋军官围在桌前,铺开地图,用铅笔画标注,用电话协调。

然后Fire Factory来了。

"火力工厂"——名字本身就暴露了意图——是以军的AI打击规划系统。它把Gospel输出的目标清单接过来,自动完成从"标注"到"方案"的全部转换:分配弹药、规划航线、排定时序、检测冲突。原本需要数小时的规划流程被压缩到数分钟。

Gospel+Fire Factory的组合,把以军的杀伤链从手工作坊变成了工业流水线——前端是机器标注目标,后端是机器规划打击,中间只剩下一个人类审批的瓶颈。

这套流水线在加沙战争中被充分验证。而到了"史诗之怒"行动,它被部署到一个规模更大几个数量级的战场上:不再是加沙地带365平方公里的城市废墟,而是伊朗164.8万平方公里的国土纵深。

首日1000多个目标——没有AI目标生成系统,这个数字在物理上不可能实现。

让我用一个简单的算术来说明:假设一个经验丰富的情报分析师每天能完成5个目标的完整标注与评估(这已经是高强度产出),1000个目标就需要200个分析师同时工作一整天,且每个人的产出必须完美无错、彼此不重叠、口径统一。这在任何军事组织中都不现实。而且这还没有算规划环节——1000个目标对应1000套打击方案,每一套都需要考虑弹药选型、航线设计、时间窗口、防空回避。用人工完成这些工作,需要的不是天,而是周。

AI把"周"压缩成了"时"。

二、战争的"表格化"

理解了规模之后,让我们走进这条链路内部,看看它实际上是怎么运转的。

想象你面前有一张Excel表格——但它不是静态的,它是活的。

表格的每一行是一个目标:核设施、导弹发射井、防空雷达站、革命卫队基地、弹药库、通信枢纽、海军码头。每一列是一组属性:地理坐标、防御等级(高/中/低)、优先级评分(0–100)、最优打击窗口(几点到几点防空最薄弱)、推荐弹药类型(GBU-31穿甲弹?战斧巡航导弹?PrSM精确打击导弹?)、预计附带损伤等级、当前卫星覆盖状态、最近一次确认时间。

这张表不是人填的。它是系统自动生成、实时更新的。每隔几秒钟,新的卫星过顶会刷新某些坐标的影像数据,某处通信截获会改变某个设施的"活跃度"评分,某架无人机的侦察视频会修正某栋建筑的功能标注。表格永远在动,永远有新行被添加、旧行被修正、优先级被重排。

你不是在"决定打谁"。你是在"执行队列"。

Maven智能系统在美军这一端扮演的角色与Gospel类似但更大:它把来自所有作战司令部的多源情报融合进一条数据管道,输出的不仅是目标清单,还包括跨军种、跨战区的协调方案。当一架B-2轰炸机正在飞向伊斯法罕的核设施时,系统同时在计算它的航线是否与一架从波斯湾起飞的F/A-18的航线冲突,是否与一枚刚从驱逐舰发射的"战斧"的弹道交叉,是否会进入一架以色列F-35的电子战干扰范围。所有这些协调,如果用人工完成,需要一间坐满参谋的作战室里不间断的喊话、确认和电话。Maven把它变成了后台自动运行的冲突检测算法。

而最让传统军事观察家不安的,不是"能打得准",而是"能随时改"。

当伊朗防空系统开始响应——某处雷达开机、某型导弹上架——系统会实时分析拦截态势,动态调整导弹的发射时序与飞行路线。打个比方:如果你同时向一个网关发送100个数据包,其中30个被防火墙拦截,传统做法是停下来、分析哪些被拦了、为什么被拦、然后手动修改路由重试。而在"自动负载均衡"模式下,系统会在毫秒级别感知拦截,自动把后续数据包切到其他路径,避开拥堵的节点,选择防火墙规则更弱的入口——整个过程不需要人类工程师碰键盘。

"史诗之怒"的打击链就像这样运行:哪条航线上拦截密度高,导弹就自动换路;哪段时间窗口防空最紧张,就错峰发射;哪个目标的防御等级在实时升高(比如移动式防空系统刚刚机动到附近),就临时调整优先级或者更换弹药类型。传统战争中,这类调整需要参谋层层上报,指挥官逐级审批,通信兵反复传达——往往等决定做出来的时候,战场态势已经又变了。在机器速度下,调整与执行之间没有缝隙。

三、防空系统的宿命——越工作越暴露

在这条动态目标链上,最具讽刺性的一幕发生在伊朗的防空系统身上。

2月28日深夜,以色列国防军宣称完成对伊朗战略防御系统的大范围打击。其中一击指向伊朗西部克尔曼沙赫省的一套Khordad-3中程防空系统。关键细节在于打击的方式:导弹的AI制导系统不是沿着预先编程的航线飞向一个固定坐标——它在飞行中实时捕捉该防空系统发射的雷达信号,像猎犬追着气味跑一样锁定信号源的方位,然后自动规避防空系统可能发射的拦截弹火力通道,修正进入角度,最终从防空系统的盲区切入。

打击命中率88%。

这个数字背后是一个残酷的逻辑倒转:防空系统为了探测来袭威胁必须开机发射雷达波,但雷达波本身就是一个向全世界广播"我在这里"的信号。在传统战争中,这个矛盾虽然存在,但攻击方利用它的能力受限于飞行员的经验和反辐射导弹的技术水平。现在,AI把这个矛盾变成了自动化的杀伤流程——信号一亮就被捕获,一捕获就被追踪,一追踪就被预测,一预测就被引导。防空系统从"盾"变成了"灯塔",越工作越暴露,越暴露越危险。

这不是个例。伊朗防空体系在"史诗之怒"行动之前已经千疮百孔:所有俄制S-300PMU-2防空导弹系统在2024年10月的以色列打击中被摧毁或瘫痪;2025年6月的"十二日战争"进一步摧毁了约120套防空发射器,占伊朗战前库存的三分之一;伊朗自研的Bavar-373本应接替S-300成为主力远程拦截系统,但数量不足以覆盖164万平方公里的国土。到2月28日,当1000多枚弹药从多个方向同时涌来时,伊朗残存的防空系统面对的不是一场可以应对的战斗,而是一场数学注定输掉的考试——题目比你多,而且每道题都会追着你的笔尖跑。

有军事观察家注意到一个不寻常的现象:在打击的中后期,防空导弹的发射频率急剧下降,取而代之的是高射炮的火光。这意味着防空系统的操作员可能已经意识到一个可怕的事实——开机就是自杀。于是他们选择了沉默。但沉默意味着天空不设防,更多的弹药得以畅通无阻地抵达目标。

这就是AI目标链的连锁效应:它不仅摧毁目标,还改变了对手的行为模式,使对手的理性选择——沉默以自保——反而服务于攻击方的战略目标——获得不设防的天空。

四、最敏感的层级——当定点清除变成"预测模型的输出"

当目标链向上攀升到最敏感的层级——高层定点清除——AI战争化暴露出它最锋利的刃口。

公开信息显示,针对伊朗最高领导层的定位,系统依赖的不是某个间谍在某个咖啡馆偷拍的一张照片,而是一种持续的、多维的、概率化的追踪方法。

人脸识别匹配卫星影像中出现在特定建筑周围的人物;轨迹分析模型整合过去数年的出行规律,叠加特定日期的时间表偏好(周几更可能在哪栋建筑、几点更可能在办公室而非住所);通信信号分析侦测特定设备的活跃位置与开关机规律;地面情报源提供近期安保调整的蛛丝马迹——这些全部被融合进一个单一的概率模型,输出的不是一个答案("他在这里"),而是一个热力图("他在此处的概率为87%,在彼处的概率为11%,其余分布在2%以下")。

你不再是在"寻找一个人"。你是在"预测他会出现在哪里"。

这意味着"定点清除"不再是情报人员的手艺活——不再需要一个乔装改扮的特工在街角蹲守,拍下一张照片,确认目标在场,然后通过加密通信呼叫打击。现在,系统在后台替你蹲守了一整年,分析了一万次出行,计算了一千个时间窗,然后把那个概率最高的"此刻"推到你面前,让你只需要做最后一个动作:批准。

"史诗之怒"行动中,40多名伊朗高级官员在首轮打击中被消灭——最高领袖哈梅内伊、武装力量总参谋长穆萨维、革命卫队总司令、高级情报主管沙姆哈尼,以及多名省级军政长官。CBS新闻引述的"40+"这个数字本身就说明了一个问题:这不是一次斩首行动,而是一组斩首行动的交响曲——多条并行的AI追踪链路在同一个时间窗口内同时收束。

用传统情报手段同时追踪40多个高价值目标、同时锁定他们的实时位置、同时完成打击方案生成、同时执行——这超出了任何情报机构的人力极限。它只有在整条追踪-定位-规划-执行链路都被自动化之后,才有可能作为一个"批量操作"来完成。

而这恰恰是最让人不寒而栗的地方:当杀死一个国家的最高领导人被做成一个"批量操作"中的一行条目,它在系统里与摧毁一座弹药库、瘫痪一部雷达在结构上没有任何区别——只是另一个被执行的队列任务。

五、"有人批准"——最精致的免责术

目标链的平台化,带来了一种前所未有的责任切割术。

它不是故意设计的。它是自然涌现的。当一条链路被拆分成多个模块,每个模块由不同的组织运营、不同的合同约束,责任就像水流过沙床一样自然地渗散。

平台可以说:"我只提供候选清单与排序算法,不做打击决策。"情报部门可以说:"我只提供原始数据与标注,不做目标评估。"军方指挥链可以说:"我有人类审核环节,每个目标都经过人工批准。"承包商可以说:"我只是按合同交付软件功能,不参与作战。"

每一句都是事实。每一句都无懈可击。但当你把它们拼在一起,你会发现一条完整的因果链——从数据采集到目标生成到方案规划到打击执行到平民死亡——被切成了碎片,落在不同组织的不同合同条款里。你追到最后会发现,没有人完整拥有这条链。

而"人类审核"这个环节——被反复援引为"有意义的人类控制"的证据——在实际操作中是什么样的?

以军在加沙战争中使用Lavender系统时的审核标准被以色列调查记者揭露:每个AI推荐的目标,人类审核的平均时间约为20秒。20秒。在这20秒里,审核人员需要判断AI的目标识别是否正确、附带损伤评估是否合理、比例原则是否得到满足。系统的错误率约为10%——也就是说,每10个AI推荐的目标中,平均有1个是错的。而每击杀一名被标记为"初级武装分子"的目标,指挥链可接受的附带平民伤亡上限是15到20人。

20秒。10%错误率。15到20名平民的"可接受"代价。

在这种条件下,人类审核员与其说是"判断者",不如说是"盖章者"——系统把一道填满了答案的试卷推到你面前,给你20秒看一眼,然后你在底部签字。你在制度上履行了"人在回路"的要求。但你真的"在"回路里吗?还是你只是回路为了自我合法化而保留的一枚人形图章?

人权观察在其评估报告中指出,以色列的AI打击工具使用了"错误数据和不精确的近似值",存在违反国际人道法中区分原则、比例原则和预防义务的风险。这段话的外交辞令译成白话就是:机器在用有问题的数据做决定,人类没有足够的时间和信息来纠正这些决定,而后果由平民承担。

六、Minab学校——队列滚动的代价

2月28日,伊朗南部米纳卜(Minab)。

一枚弹药命中了一所学校。148人死亡。

在所有战争中,学校被炸都是最刺痛公众神经的事件之一。发动打击的一方通常会提供两种解释中的一种:这是武装分子利用民用设施的人体盾牌策略,或者这是坐标误差导致的误击。两种解释都有可能是真的。但在AI目标链的语境下,一个更结构性的问题浮出水面:当系统每天生成100个(或更多)目标时,每一个目标都经过了多少人类注意力的浇灌?

如果你是一个审核员,面前的屏幕每隔几秒钟刷新一次,新的目标卡片像社交媒体的信息流一样源源不断地涌来,每张卡片上标注着坐标、卫星缩略图、AI评估的置信度评分、推荐打击方案——你的20秒足以看出这张缩略图上的建筑是军事设施还是学校吗?特别是当建筑在夜间被拍摄、像素模糊、AI已经给了它"军事设施·置信度89%"的标签时?

我不知道Minab学校是被误标为军事目标,还是被正确标注但附带损伤评估失误,还是AI根本就是对的但现实中的学校与卫星图中的军事设施长得太像了。公开信息不足以判断。但我知道一件事:当目标从情报对象变成数据条目,条目从静态列表变成动态队列,队列一旦滚动起来,它就会把误差也一起滚动进去。148条生命成为队列滚动的统计学代价。

同一天还有:德黑兰尼鲁法尔广场,20名平民死亡;另一处德黑兰空袭,2名学生死亡。伊朗红新月会的首日统计:201名平民死亡,747人受伤。

201人。在一个被设计来"最大化精准度"的AI打击体系下。

这就是AI目标链最深的悖论:它确实让打击更精准了——92%的命中率,历史上闻所未闻的数字。但它同时让打击更多了——1000个目标,同样是历史上闻所未闻的密度。当精准度的提升被数量的膨胀吞噬,总的平民伤亡未必减少——它只是被重新分布了:每个目标的附带损伤更小,但目标的数量更大,最终的总和可能是一样的,甚至更多。

精准是一个乘法:它乘以数量,才是后果。AI同时放大了乘号两边的数字。

七、停不下来的队列

现在让我们回到那张"活的Excel表格"。

打击进行到第12个小时。1000多个预设目标中的大部分已经被执行。按照传统战争的逻辑,这里应该出现一个自然的停顿——评估战果,清点弹药,让飞行员休息,让指挥链喘口气,让政治决策者重新评估是否继续。

但队列没有停。

因为系统不需要喘气。卫星仍在过顶,无人机仍在侦察,信号情报仍在截获。每一条新数据都被自动融合进模型,每一次融合都可能产生新的目标候选——某个之前隐蔽的移动导弹发射车被发现了,某个之前评估为低优先级的设施在打击后出现异常活动升级为高优先级了,某个之前不在清单上的通信节点因为其他节点被摧毁后变成了关键枢纽。

新的行不断被添加进表格。新的队列不断被生成。系统永远有"下一条候选"等在那里。

当战争以人类节奏运行时,它有自然的呼吸——疲劳、犹豫、反思、恐惧。这些"缺陷"恰恰是减速带,是战争在自己体内安装的刹车片。将军会累,飞行员要睡觉,参谋会在凌晨三点开始怀疑某个目标是否真的值得再打一轮。

但当战争以机器节奏运行时,这些刹车片被拆掉了。系统不疲劳,不犹豫,不恐惧。它只是持续运行。而它每持续运行一秒,就多生成一个候选。停火最大的障碍不再是政治意愿——也许双方都想停——而是系统的结构性惯性:队列里还有目标没打完,算法还在生成新的候选,每一个候选都带着一个诱人的置信度评分在等着被批准。

在这种结构下,"停火"需要克服的不仅是敌意,还有惯性——一种比人类意志更冷、更稳、更难被说服的惯性。

(未完待续:下一篇抬头看天空——LUCAS无人机蜂群的实战首秀与伊朗的反蜂群策略。当$35,000的无人机可以击毁价值数百万的防空系统,当蜂群在断网断联后仍能自主作战,战场变成了"模型对模型"的竞赛——而竞赛的真正恐怖之处在于,每一场交火都是下一场交火的训练数据。)

留下评论