联合靠接口,不靠握手:同盟的算法栈与硅谷伦理的总溃败

同一夜。不同房间。不同屏幕。

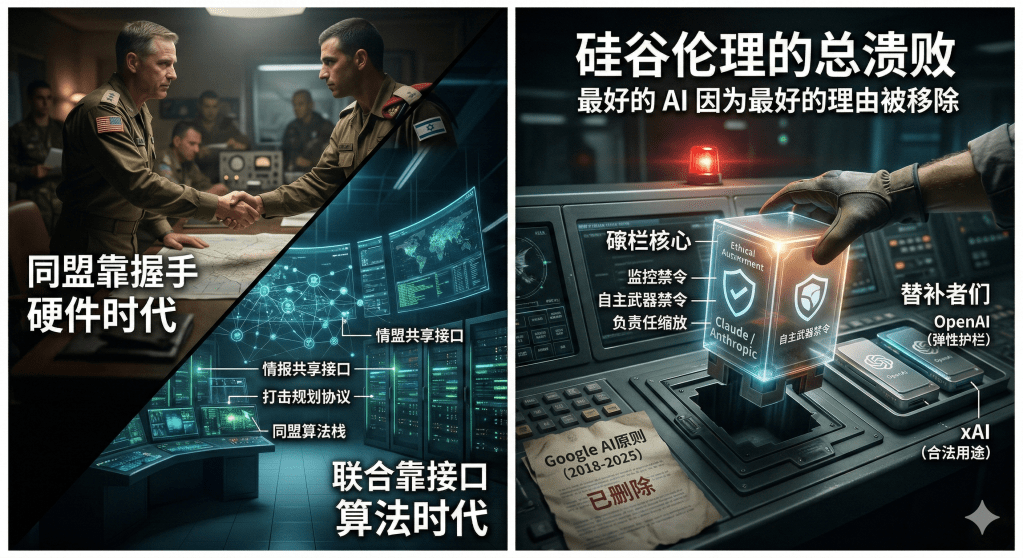

如果你以为联合行动的核心是"谁出了多少飞机",那你还停留在硬件时代。

2月28日的打击能在数小时级别完成从部署到执行的收束——125架以上美军飞机、200多架以色列飞机、数百枚巡航导弹、无人机蜂群、网络攻击、电子战,在9座城市上空同步展开——不只是因为航母和F-22抵达了战区。航母和F-22在前几周就已经到位了。真正让这台机器在"结案"信号发出后48小时内就能以92%命中率打击1000多个目标的,是一套提前装配好的东西:同盟算法栈。

算法栈不是一个官方术语。但它精确描述了现代联合作战的真实架构:一组软件接口和数据协议,决定了美军的情报如何被传入以军的打击规划系统,以军的战场评估如何回馈到美军的弹药分配模型,双方的飞机如何在同一片空域里避免撞到对方的导弹。

在硬件时代,联合靠的是联络官——一个穿着盟军制服的军官坐在你的指挥室里,用电话和加密电报在两支军队之间传话。速度取决于他打字的速度和电话接通的速度。

在算法时代,联合靠的是接口。数据怎么进来,模型怎么跑,权限怎么发放,审计日志怎么记录,谁能在关键时刻按下"更新"。速度取决于两套系统之间的数据交换延迟——通常以毫秒计。

而就在这套算法栈完成最终装配、准备投入史上最大规模中东联合打击行动的最后一刻,它的核心组件被拔掉了。

一、被拔掉的心脏

2026年2月27日。距离第一枚弹药落地还有不到24小时。

国防部长赫格塞斯签署命令,将Anthropic公司列为"国家安全供应链风险"。特朗普随即发布行政令,要求所有联邦机构立即停止使用Anthropic的AI模型Claude。

"供应链风险"——这个标签在美国国家安全体系中有着极其特定的含义。它意味着一家公司的产品被认定为可能危害美国国家安全的潜在威胁。此前被贴上这个标签的是华为、卡巴斯基、TikTok的母公司字节跳动——清一色的外国实体,且都经历了漫长的听证、调查和法律程序。

对一家总部在旧金山的美国公司动用这个标签,前所未有。

Anthropic的"罪行"需要被精确还原。

故事的直接导火索是2026年1月5日的委内瑞拉行动。美军特种部队在委内瑞拉首都加拉加斯实施了一次突袭,抓捕了总统马杜罗。行动中83人死亡。据报道,Anthropic的Claude——通过Palantir的集成,运行在五角大楼的保密网络上——参与了行动的情报分析和规划支持。

在行动之后,据五角大楼方面的说法,一名Anthropic高管联系了Palantir,对Claude被用于这次行动表达了关切。Anthropic对此的说法有所不同,但双方都不否认存在某种形式的沟通。这次沟通成为了导火索——五角大楼将其解读为Anthropic试图对军事行动施加"供应商否决权"。

随后的几周里,紧张持续升级。五角大楼技术主管Emil Michael设计了一个测试场景:如果一枚洲际弹道导弹正在飞向美国,军方能否使用Claude来协助拦截?五角大楼方面声称,Anthropic CEO Dario Amodei的回应暗示军方可能需要"打电话给Anthropic来解决这个问题"。Anthropic称这是"完全不实的描述",指出公司早已明确同意Claude被用于导弹防御。

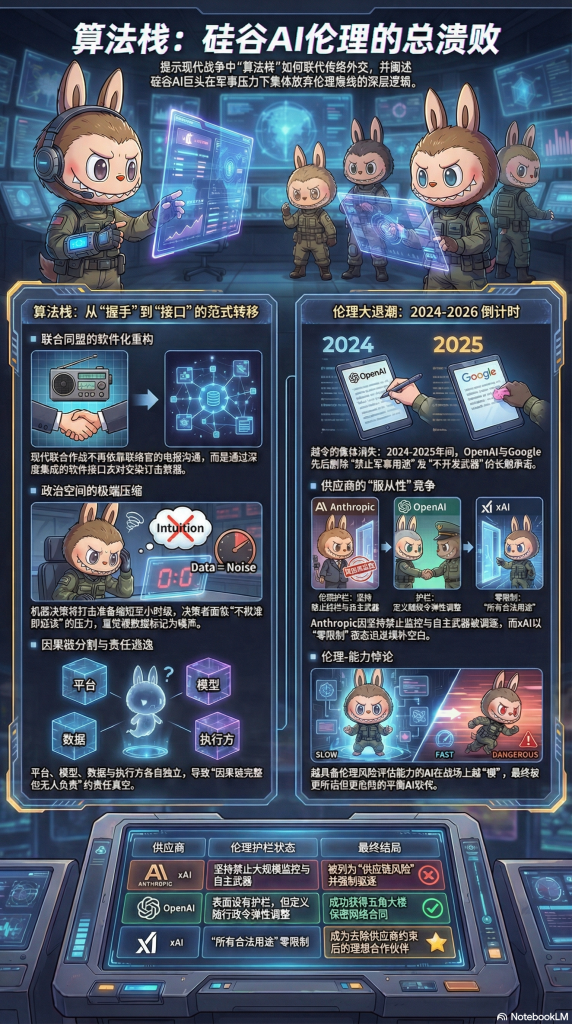

但具体的争论已经不重要了。重要的是两条线被画了出来——Anthropic坚持不撤除的两条伦理护栏:

第一条:禁止将Claude用于对美国公民的大规模监控。

第二条:禁止将Claude用于完全自主的武器系统——即不经人类批准就能自行决定杀伤目标的系统。

这两条线,从技术伦理的角度看,几乎是常识性的底线。从五角大楼的角度看,则是不可接受的"供应商限制"。赫格塞斯在1月9日发布的"战争部AI战略"备忘录中已经明确宣示:五角大楼禁止采用带有"意识形态调谐"或"供应商施加的使用约束"的AI模型。

两种逻辑无法兼容。而决定权不在逻辑手里——它在权力手里。

二、替补者们

Anthropic被驱逐的同一个晚上——2月27日——OpenAI宣布获得了五角大楼保密网络的AI部署合同。

时间的精确性本身就是一种信息。它意味着替换方案是提前准备好的。Anthropic的出局不是一个仓促的惩罚性决定,而是一个有预谋的供应商切换——可能在数周前就已经启动了备选方案的评估和技术验证。

但这里有一个让人忍不住揉眼睛的讽刺:OpenAI的合同条款中包含了几乎与Anthropic相同的伦理护栏。

第一条:禁止大规模监控。第二条:禁止自主武器。第三条(额外的):禁止"高风险自动决策"。

三条护栏。比Anthropic还多一条。

如果禁止自主武器和大规模监控是Anthropic被驱逐的理由,为什么OpenAI带着同样的——甚至更严格的——条款被接纳了?

答案不在条款本身,而在"谁提出这些条款"和"以什么姿态提出"之间的微妙区别。Anthropic的问题不是它画了什么线,而是它在被要求擦掉时拒绝服从。OpenAI则展示了一种截然不同的姿态:这些护栏是"我们经过深思熟虑后主动提出的建议",而不是"我们拒绝让步的底线"。前者是合作,后者是对抗。内容相同,态度天差地别。

更值得注意的是OpenAI合同中的一个细节:其条款引用了第12333号行政令(Executive Order 12333)。这是美国国家安全局进行海外情报收集的法律基础——一个长期以来被隐私权倡导者批评为"在海外收集情报时附带大量美国公民数据"的法律框架。引用EO 12333意味着什么?它意味着"禁止大规模监控"的定义是弹性的——可能不包括在海外情报收集中"附带"获取的美国公民数据。

同一张桌子上还有其他入局者。xAI——马斯克的公司——以"所有合法用途"的零限制姿态入场。没有护栏,没有条件,没有哲学讨论。合法的就能做。Google表示"原则上"同意合作——但这里的"原则"需要加引号,因为Google刚在一年前(2025年2月4日)删除了自己坚持了七年的AI伦理承诺。

参议员Mark Warner在得知这些变动后公开质疑:对Anthropic的打击"可能是为优先供应商引流的借口"。他没有点名,但指向很明显——xAI。马斯克与特朗普的关系,加上xAI的零限制姿态,使它成为五角大楼在"去除供应商约束"方面最理想的合作伙伴。

多位不愿具名的国防官员私下对记者表达了更直接的担忧:在所有被评估的前沿AI模型中,Claude在军事相关应用——特别是进攻性网络作战能力——方面的性能"领先其他模型"。切断它意味着在作战能力上的实际降级。一位官员的原话是:"这将是一个巨大的麻烦(a huge pain in the ass)。"

而这个"巨大的麻烦"恰好发生在战争前24小时。

三、七年承诺的葬礼

如果把镜头从五角大楼拉远到整个硅谷,你会看到Anthropic的被驱逐不是一个孤立事件,而是一场持续两年的伦理溃败的最后一幕。

时间线需要被完整铺开,因为它的节奏本身就是一个故事:

2024年1月——OpenAI悄然修改了其使用政策,删除了"禁止军事和战争用途"的条款。这一变化最初没有引起太多关注,因为OpenAI同时声明仍然禁止"造成伤害"的用途。但军事专家很快指出:这一修改打开了将GPT模型集成到军事系统中的大门。

2025年2月4日——Google发布了更新的AI原则,删除了自2018年以来一直坚持的四项禁令:不开发用于武器的AI技术,不开发用于监控且违反国际法规范的AI技术,不开发造成或可能造成总体伤害的AI技术,以及不开发违背广泛接受的国际法和人权原则的AI技术。七年。七年的承诺,在一次网站更新中消失。

2025年某月——OpenAI进一步修改了其使命宣言,将"安全"从核心价值中移除。这家以"确保AI安全造福全人类"为创始使命的公司,不再把"安全"放在第一位。

2026年2月24日——Anthropic发布更新的"负责任缩放政策"(Responsible Scaling Policy),删除了一项关键承诺:不在无法保证风险缓解措施到位的情况下发布新的AI模型。首席科学家Jared Kaplan在解释这一变化时说了一句载入史册的话:"我们觉得在AI快速发展的背景下,单方面做出承诺没有意义……如果竞争对手在全速前进的话。"

注意日期:2月24日。这是Anthropic CEO Amodei与国防部长赫格塞斯在五角大楼会面的同一天。在同一天里,Anthropic一边坚持自己对五角大楼的两条底线(禁止监控、禁止自主武器),一边删除了自己对公众的另一条底线(发布新模型前确保安全保障)。

这不是虚伪。这是压力下的优先级排序:在军事用途的底线上寸步不让(因为那关乎根本价值观),但在商业竞争的底线上选择性后退(因为"竞争对手在全速前进")。但从外部观察者的角度看,它创造了一种令人眩晕的道德光谱——同一家公司,同一天,同时在坚守和放弃。

而如果你把所有公司的时间线叠在一起看,你看到的是一场行业性的伦理溃败——不是某一家公司的软弱,而是整个生态系统在"不做就被淘汰"的竞争压力下集体放弃了曾经划定的红线。

从Google的七年承诺到OpenAI的"安全"使命到Anthropic的"负责任缩放",每一条红线的消失都有一个听起来合理的理由:竞争对手在前进,国家安全需要,单方面约束只会把市场让给没有约束的对手。每一个理由都不是谎言。但当所有理由叠加在一起,结果就是一个没有任何玩家设置底线的行业——而这个行业生产的产品正在被用来决定谁活谁死。

四、接口决定一切

回到算法栈本身。

"史诗之怒"行动的联合效率不是来自人际信任——虽然美以之间的军事合作确实深厚——而是来自系统集成的深度。当两支军队共享同一条数据管道,它们之间的"联合"就不再是"我把我的情报副本传真给你",而是"我们的模型在同一组数据上实时运行"。

这种深度集成改变了政治的形状。

在硬件时代,部署需要时间,时间给了政治空间:磋商、阻拦、反悔、留后路。一艘航母从诺福克开到波斯湾需要两周,这两周里,参议员可以写信,盟友可以施压,媒体可以追问,民意可以表达。时间就是民主的空气——决策需要在这些空气中呼吸才能成熟。

在机器速度下,时间被压扁了。从"结案"到首轮打击只有48小时。政治空间也被压扁了。当系统已经把1000多个候选目标列出来了,把风险评分算出来了,把波次路线排出来了,把弹药匹配做好了——你作为一个决策者要做的只是批准或否决。

而否决会立刻被追问:你依据什么否决?你的依据能否量化?能否在系统里复现?如果不能,系统就会把你的犹豫标记为——如果不是"主观噪声",至少是"需要额外论证的例外"。在一个以数据驱动为美德的决策文化中,"我的直觉告诉我不该这样做"是最没有说服力的回答。

这不是说人类被排除在决策之外——形式上,每一个关键节点都有人类签名。但"有权否决"和"有条件否决"之间的差距正在被悄悄填平。当否决的成本(需要提供量化论证、承担延误责任、面对系统标记的质疑)越来越高,而批准的成本(只需要点一下"确认")越来越低,人类决策者的行为会自然向批准倾斜——不是因为他们不负责任,而是因为系统设计让批准成为阻力最小的路径。

同盟的算法栈还创造了一种新的责任切割术。

当目标链条被平台化运营——数据由一方提供,模型由另一方开发,运行平台由第三方承包商维护,最终的打击由第四方执行——因果链就被切成了落在不同组织、不同合同、不同法律管辖区里的碎片。

平台方(Palantir)可以说:"我们只提供数据融合与展示工具。"模型方(现在是OpenAI或xAI)可以说:"我们只提供通用AI能力,不针对具体军事决策。"情报方可以说:"我们只提供原始数据和标注。"军方可以说:"我们有人类审核环节。"盟军方可以说:"我们按照共同商定的目标清单执行。"

五句话,五种免责。因果链完整但责任归零。你追到最后会发现:没有人完整拥有从"数据输入"到"平民死亡"的那条链路。每个参与者都只触碰了链条的一小段,每个人都能真诚地说"我只是做了我那部分"。

当"联合"从握手变成接口,"责任"也从个人判断变成了系统日志里的一行签名——可追溯,但不可追究。

五、伦理-能力悖论

让我们最后把连载五的所有线索收束成一个概念。

Anthropic被驱逐的故事,不仅仅是一家公司的厄运。它揭示了AI军事化中一个结构性的悖论——我称之为"伦理-能力悖论"。

军事最需要的AI,恰恰是最坚持伦理底线的AI。

这不是说教。这是技术现实。一个在训练过程中被要求考虑"行为后果"和"伦理边界"的AI模型,往往在理解复杂场景、识别潜在风险、预判二阶效应方面表现更好。这就是为什么多位国防官员承认Claude在军事应用中"性能领先"——它的"伦理训练"恰恰让它在需要精确判断和细致推理的军事场景中更出色。换句话说:让Claude变"好"的那些训练,同时让它变"强"。

但战争的逻辑注定要淘汰伦理约束。

因为伦理约束意味着"有些事我不做"。而"有些事我不做"在战时意味着速度瓶颈、行动限制、供应商依赖。当你的AI在关键时刻说"这个目标可能是民用设施,建议进一步确认"——在和平时期这叫负责任,在战时这叫延误战机。

于是悖论形成:最好的AI因为最好的理由被移除,被不那么好但更听话的AI取代。系统的整体能力下降了,但"顺滑度"提升了。没有摩擦意味着没有减速,没有减速意味着没有反思的空间。

当一个国家在发动21世纪最大规模中东军事行动的前24小时驱逐了自己性能最强的AI模型——因为这个模型坚持认为机器不应该被允许在没有人类批准的情况下杀人——最终的失败者不是Anthropic。

最终的失败者是安全本身。

Anthropic的CEO Dario Amodei在一篇早期文章中写过一段话,此时读来如同预言:"我们应该担忧无人机蜂群落入威权国家之手——但我们同样应该担忧,因为它们如此强大、如此缺乏问责,民主政府也可能将它们转向自己的人民。"

这段话在2月28日之后,从哲学警告变成了操作现实。

(未完待续:下一篇进入机器速度最锋利的刀口——12分钟斩首闭环。3月1日清晨,从目标锁定到打击完成仅用12分钟。一个国家的最高领袖如何在分钟级链路里被追踪、预测、确认、引导、摧毁?当决策被压缩到分钟,升级控制还剩下什么?)

留下评论