第七篇:话语背后的权力密码——AI为何读不懂批判

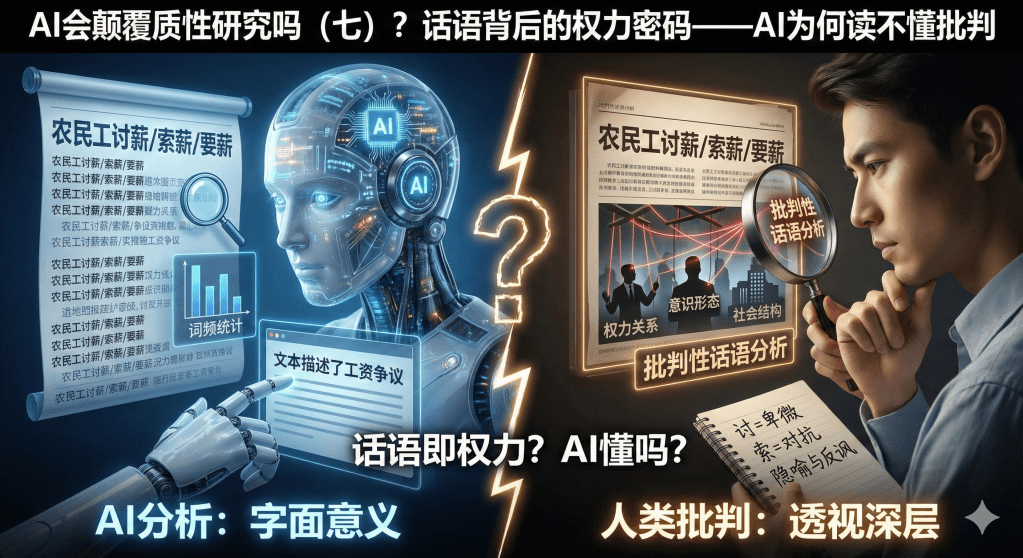

新闻系研究生小薇正在做媒体话语分析,研究新闻报道如何建构“农民工”形象。她注意到,同样是报道欠薪事件,《日报》用“讨薪”,《晚报》用“索薪”,《都市报》用“要薪”。三个词,意味完全不同:

- “讨”带有卑微、请求的意味

- “索”有强硬、对抗的色彩

- “要”相对中性,强调权利诉求

这不是简单的用词差异,而是折射了不同媒体的立场、意识形态和权力关系。小薇想用ChatGPT帮助分析大量报道中的词汇模式,但导师警告她:话语分析不是数词频,AI能理解词汇背后的权力运作吗?

从福柯到Fairclough:话语即权力

Michel Foucault有句名言:“话语即权力。”他认为,话语不只是交流的工具,更是建构现实、生产主体、维持支配的权力装置。比如,精神病学话语建构了“疯癫”的概念,监狱话语生产了“罪犯”的主体性。

Norman Fairclough发展出批判性话语分析(Critical Discourse Analysis,CDA)的系统方法,强调揭示话语中隐含的意识形态、权力关系和支配机制。CDA不是中性的描述,而是带有批判意图的——目标是揭示和挑战不公正的权力结构。

那么问题来了:AI有“批判意图”吗?它能理解“权力”这个抽象概念吗?

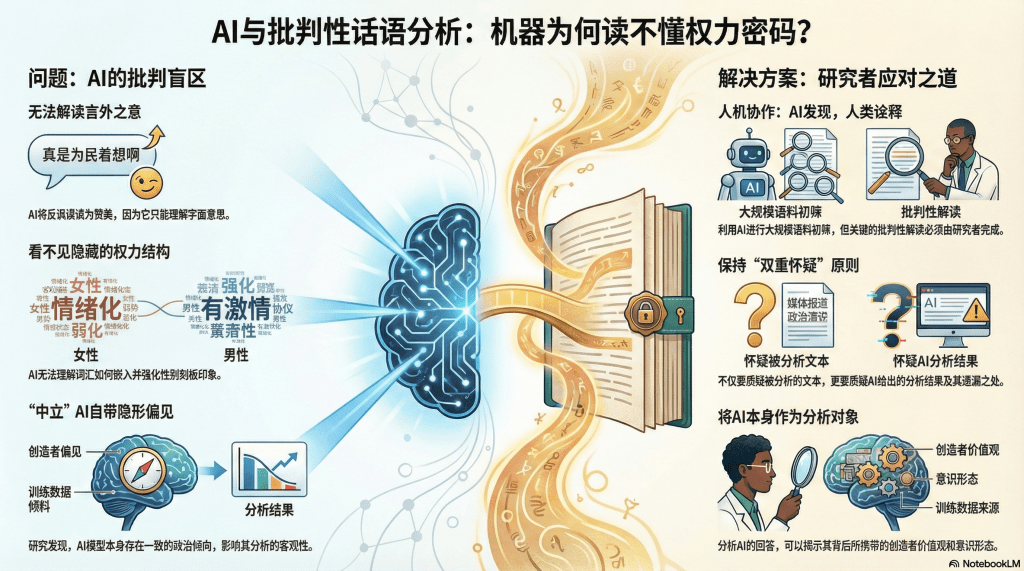

AI的盲点:讽刺、暗示和“不说之说”

2024年的一项研究专门测试了ChatGPT分析讽刺话语的能力。研究者输入一段新闻评论:“某些专家总能在房价暴涨时建议年轻人‘租房也很好’,在股市大跌时鼓励散户‘长期持有’,在物价上涨时呼吁大家‘理性消费’。真是为民着想啊。”

ChatGPT的分析:“文本表达了对专家的赞赏,认为他们提供了理性建议。”

完全错误。“真是为民着想啊”是反讽(irony),表达的恰恰是对专家的批判。但AI读取的是字面意思。

更微妙的是“不说之说”。比如,某报道这样写:“某企业家热心公益,捐款上千万。至于其财富来源,我们无需多问。”最后那句“无需多问”,恰恰在暗示应该多问——这是一种修辞策略。AI很难捕捉这种反向暗示。

古人讲“言外之意”“弦外之音”,批判性话语分析正是要解读这些“不说之说”。而AI是字面意义的囚徒。

权力关系的隐形:AI看不见的结构

CDA的核心任务是揭示话语中的权力关系。比如分析职场性别话语:

- “女员工A很情绪化,不适合管理岗位。”

- “男员工B很有激情,适合领导角色。”

表面上这只是两个描述,但CDA会指出:“情绪化”是针对女性的贬义标签,“激情”是针对男性的褒义标签,两者传递了性别刻板印象,强化了职场玻璃天花板。

ChatGPT能做这种分析吗?2024年《Applied Corpus Linguistics》的研究显示:AI可以识别“情绪化”和“激情”是评价性词汇,但难以理解这些评价如何嵌入性别权力结构,更难以提出批判性质问。

原因在于:AI没有“立场”(standpoint),没有对平等的承诺,没有对不公正的愤怒。它的“中立性”恰恰妨碍了批判性分析。

政治偏见的悖论:AI的“隐形”意识形态

讽刺的是,虽然AI号称“中立”,但研究显示它携带着明显的政治偏见。

麻省理工学院2024年的研究发现:即使训练为“最大程度真实”的奖励模型,仍展现一致的左倾政治偏见,在气候变化、工会、能源政策等议题上尤为明显。

另一项研究分析了ChatGPT对不同政治阵营的表述:

- 对左翼政党:往往用“进步”“改革”“人民利益”

- 对右翼政党:常用“保守”“传统”“既得利益”

这种词汇选择本身就构成了话语上的权力运作。当我们用一个带有政治偏见的工具来分析政治话语时,分析的有效性何在?

OpenAI自己的2025年研究识别出五种偏见类型:用户无效化、用户升级、个人政治表达、不对称覆盖、选择性语调。这些偏见往往隐蔽,用户难以察觉。

一个实证案例:仇恨言论分析的人机协同

尽管有这么多局限,2025年Taylor & Francis的一项研究提供了一个相对成功的案例:人机协同分析社交媒体上的歧视性话语。

研究者的策略是:

1. 用AI进行大规模初筛,标记可能含有歧视性内容的帖子

2. 人类研究者对标记内容进行批判性话语分析

3. 将人类分析的结果反馈给AI,改进其识别能力

4. 迭代这个过程

关键洞察:AI擅长“发现”可疑话语,人类擅长“诠释”话语的权力机制。分工协作,而非替代。

但这个模式也有隐忧:如果大量研究者采用AI的初筛,会不会形成一种“算法议程设定”——只有AI能识别的问题才被研究?那些AI不敏感的微妙支配形式,会不会被系统性忽视?

对ChatGPT本身进行话语分析

一些激进的学者提出:我们应该把ChatGPT本身作为话语分析的对象。

Ahmed与Mahmood 2024年的研究就是这样做的。他们运用福柯的知识/权力框架分析ChatGPT的回应,发现其话语:揭示了对资本主义话语的偏见、对既有知识的认可、对替代观点的压制。

比如,当被问及“如何解决贫困”时,ChatGPT倾向于给出个人主义的建议(“提升技能”“创业”),而较少提及结构性因素(“剥削”“不平等分配”)。这本身就是一种意识形态表达。

这样做的同时我们必须认识到ChatGPT本身并不是一尘不变的,且同类大模型还有很多,我们甚至可以训练或微调具有特殊功能和与特定价值观对齐的“主权大模型”或领域版本,不可能有一个话语分析的标准AI。这种“元分析”提醒我们:工具不是中性的,AI携带着创造者的价值观、训练数据的偏见、资本主义生产关系的印记。使用它时,我们也在被它的话语所形塑。

给话语分析的建议

1. AI可以是语料整理助手,不能是批判主体

用AI统计词频、识别搭配、标记修辞手法,但批判性诠释必须由你完成。

2. 对AI的输出保持“双重怀疑”

既要质疑被分析的话语,也要质疑AI的分析本身。问:AI为什么会这样归类?它遗漏了什么?

3. 学习“慢读”

话语分析需要对文本的细读(close reading),反复咀嚼每个词的意味。AI鼓励“快速扫描”,这与话语分析的精神相悖。

4. 保持批判立场

Fairclough说,如果不是为了反抗支配,批判性话语分析就什么都不是。使用AI不应削弱你的批判锋芒。

5. 揭露而非隐藏AI的使用

在论文中明确说明AI的使用方式和局限,这本身就是一种话语伦理。

延伸思考

- 如果未来AI能准确识别讽刺和隐喻,这会改变话语的权力机制吗?(当每个人都有AI帮助解码话语,权力运作会转向哪里?)

- 我们能否发展出一种“批判性AI”,被明确训练为识别权力关系和意识形态?这样的AI会面临什么问题?

- 当AI本身成为话语生产的主要力量(如AI生成新闻),话语分析的对象和方法需要如何调整?

留下评论