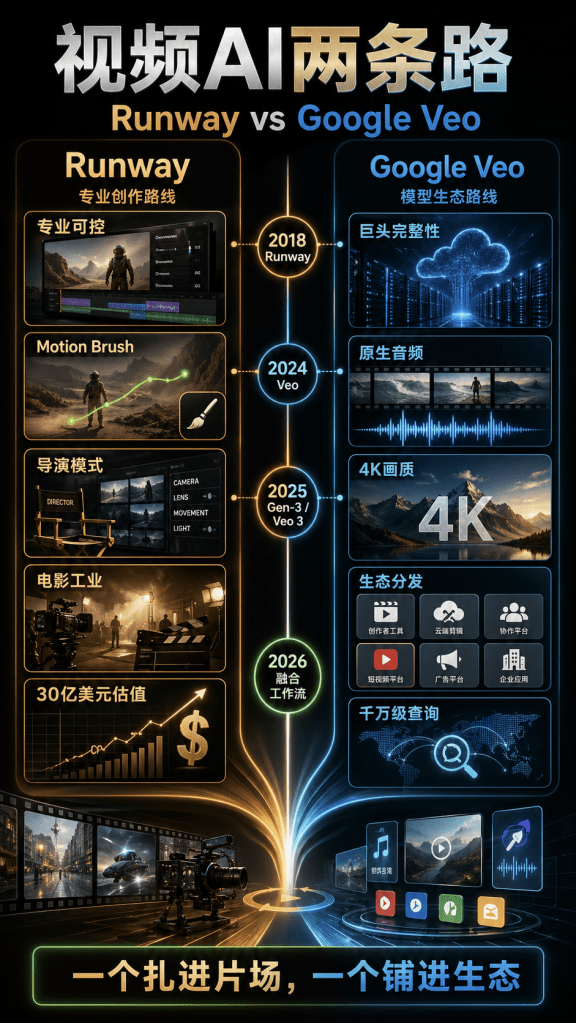

两条不同的路

在纽约的一个联合办公空间里,有一个可能是全球最”电影化”的初创公司。办公室的墙上贴满了电影海报、概念美术、镜头分析图。这就是Runway。在北方的谷歌DeepMind总部,研究人员们在超级计算机上进行着一场关于”视觉理解”的基础研究。这就是Google Veo的诞生地。

一个是创业公司的激情与执着,一个是科技巨头的资源与理性。两条路线都有各自的逻辑,都值得深入了解。

Runway:那个把AI带进电影院的人

三个NYU校友的梦想

2018年,当Cristóbal Valenzuela、Alejandro Matamala和Anastasis Germanidis在纽约大学Tisch艺术学院相聚时,没人预料到这会开启一个新的时代。

Cristóbal Valenzuela是CEO,一个充满激情的视觉艺术家,之前在Snapchat担任过技术岗位。但他真正的梦想是让AI成为创意工作流的一部分,而不是一个生冷的工具。Alejandro Matamala是首席研究官,负责Runway的技术DNA。Anastasis Germanidis是首席技术官,这位天才程序员让Runway的工程愿景成为现实。

在这三个人的组合中,有一个特别的化学反应:他们既理解艺术,也理解代码。这在AI创业公司中并不常见。大多数AI公司的创始人要么来自学术界,要么来自科技圈,很少有人真正在艺术和技术的交界处生活过。

从”研究工具”到”电影制作设备”

Runway最初不叫Runway,也不是做视频生成的。在2018-2020年的这个时期,它是一个”机器学习创意平台”,让艺术家可以在浏览器中快速实验各种神经网络模型。那时候的Runway就像是一个”AI的Photoshop”。

但Valenzuela有一个更大的野心。2021年,Runway推出了Gen-1(第一代视频生成模型)。这个模型虽然还很原始,但它证明了一个关键的点:AI可以理解动作、理解光线、理解情感。

到了2022-2023年,Runway的Gen-2模型已经能够生成足够质量的视频片段,可以被集成到实际的电影制作流程中。虽然不是全部,但”一部分”已经可以了。

Everything Everywhere All At Once的分水岭

如果说Runway从”有趣的工具”升级到”电影工业必需品”的转折点是什么,那就是《Everything Everywhere All At Once》(万物理论的衍生,中文译为《一切无处不在》)。

这部2023年的奥斯卡最佳影片,使用了Runway的AI视频生成工具。具体来说,视觉特效艺术家Evan Halleck用Runway的绿幕移除工具,在岩石宇宙(Rock Universe)的场景中工作。传统的方法需要几天的人工修饰,Runway的工具在几分钟内就完成了同样的工作——而且质量更好。

Halleck说过一句话,特别能说明问题:”它比我的人眼还要精准,给了我一个完美的遮罩,我可以用在其他的工作流程中。”

这不是”AI替代人”的故事,而是”AI让专业人士工作更高效”的故事。这个微妙的区别改变了一切。突然之间,好莱坞的视觉特效部门开始认真地看待Runway。不是作为”未来的威胁”,而是作为”现在的工具”。

Gen-3 Alpha:一个新的基准

到了2024年6月,Runway推出了Gen-3 Alpha。这个模型是在大规模的视频和图像数据上共同训练的,支持Motion Brush(运动刷)、Advanced Camera Controls(高级摄像机控制)和Director Mode(导演模式)等高级功能。

最关键的是,Gen-3 Alpha证明了Runway不仅仅是在”缩小与Sora的差距”,而是在”开拓自己的道路”。它的特色不在于单纯的”逼真度”,而在于可控性。

一个电影制作人的评价很能说明这一点:”Runway给了我的不是一个完整的视频,而是一个我可以精细调整的创意工具。我可以改变摄像机的轨迹,改变某个角色的动作,改变光线的方向。这就像Photoshop对静图做的事,但在时间维度上。”

融资与野心

到2025年的第二季度,Runway已经融资超过5.44亿美元。在最新的融资中,他们以30亿美元的估值融资了3.08亿美元(Series D)。投资者包括Google、Nvidia、Salesforce Ventures——这些都是科技产业中最精明的投资者。

他们为什么投资Runway?因为他们看到了一个明确的答案:这家公司不仅仅是在做技术研发,而是在改造一个几十亿美元的产业。

Google Veo:科技巨头的沉着思考

DeepMind的长期布局

Google Veo来自于Google DeepMind,这是Google最强大的人工智能研究部门。2024年5月,Google在I/O大会上首次亮相了Veo。

与Sora的”惊人”发布方式不同,Google的风格是”科学的稳重”。他们先发表了一篇技术论文,详细解释了Veo背后的算法原理。然后才在VideoFX和Gemini应用中限制性地推出了测试版。

这是Google的DNA。他们不相信”颠覆性发布”,他们相信”基础研究的力量”。

Veo 2和Veo 3的进化

到2024年12月,Google推出了Veo 2。这个版本支持4K分辨率,对物理和光学的理解大幅提升。Veo 2不仅能生成视频,还能生成看起来像电影的视频。

但真正的转折点是2025年5月的Veo 3。Google在这个版本中加入了一个革命性的功能:原生音频生成。

这意味着什么?这意味着你不再需要先生成视频,再分别生成音效和对白,然后通过第三方工具进行同步。Veo 3可以一次性完成所有工作——视觉、对白、音效、背景音乐都在一个模型中生成,天然同步。

到2025年10月,Google又推出了Veo 3.1和Veo 3.1 Fast。3.1版本进一步改进了从图片生成视频的能力,3.1 Fast则提供了一个”快速但品质稍低”的选项,让用户可以快速迭代创意。

为什么Google可以这样从容地迭代?

一个关键的原因是计算能力。Google拥有全球最大的计算资源。要训练Veo这样级别的模型,需要海量的计算。一个创业公司可能需要花费千万甚至亿级别的美元来做这件事,但对Google来说,这只是日常运营的一部分。

而且,Google不需要依赖外部融资。他们可以承受长期的研发投入,而不担心投资者的压力。这让他们有余裕去做”虽然现在不赚钱,但未来可能很重要”的事情。

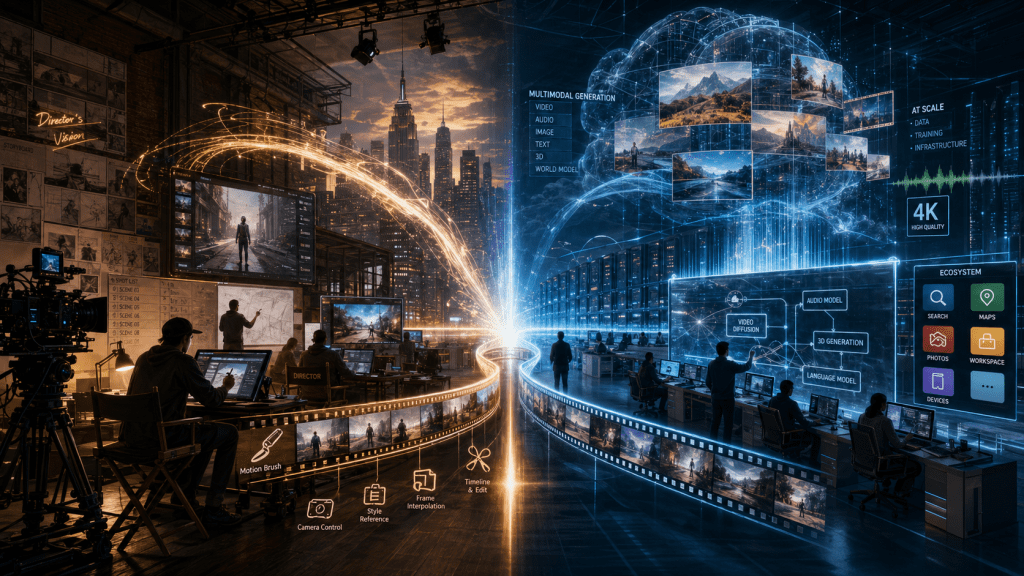

两个科技路线的差异

Runway和Google Veo虽然都在做视频生成,但他们的设计哲学完全不同:

Runway强调可控性和专业集成。它设计的逻辑是:”我要成为电影专业人士的工具。”所以它提供了Motion Brush、Director Mode这样的细粒度控制。它的界面针对专业人士设计。

Google Veo强调理解和完整性。它设计的逻辑是:”我要能够从少量的信息(一个提示、一张图片)生成出完整、高质量的视频。”所以它投入了大量的资源去改进对视觉和音频的理解。

换个角度说:如果你是一个广告代理商,你可能会用Runway来快速生成视觉特效和镜头。如果你是一个内容创作者或营销人员,你可能会用Veo 3来快速生成短视频内容。

与竞争对手的博弈

虽然Runway和Veo在不同的生态中运作,但他们确实在间接竞争——争夺用户的时间和工作流。

2025年末的市场数据显示,在专业视觉特效工作室中,Runway的采用率更高。但在内容创作平台(Google Photos、Google创意套件)中,Veo的集成度更深。

一个有趣的数据点:截至2025年底,Google用户对Veo的日均查询量已经超过1000万。虽然这个数字包含了实验性的查询,但它表明了一个事实——Google有能力让一个产品直接接触全球用户。而Runway则需要通过”产口碑”和”行业影响力”来扩展市场。

未来:融合还是对立

到2026年,Runway和Google Veo的竞争会更加激烈吗?

从一些迹象来看,答案可能是:他们正在渐渐变成互补而非竞争的关系。

Google已经推出了”Veo 3与Creator Studio的集成”,允许专业人士在Google的环境中进行更细粒度的视频编辑。Runway则在与Adobe洽谈集成,可能很快会在Premiere Pro中出现。

到最后,这可能不是”谁赢了”的问题,而是”用户会在什么时候用哪个工具”的问题。就像Photoshop和Illustrator虽然是竞争关系,但他们在很多专业工作流程中是互补的。

快速档案 · 上篇

█████████████ Runway | 创意工具的先驱【公司名】Runway ML【创始人】- Cristóbal Valenzuela(CEO,视觉艺术家+技术人)- Alejandro Matamala(首席研究官)- Anastasis Germanidis(首席技术官)【创立时间】2018年【所在地】纽约【核心产品】- Gen-1(2021):首个视频生成模型- Gen-2(2022-2023):可集成于电影制作的模型- Gen-3 Alpha(2024-2025):支持多种控制模式【关键特性】- Motion Brush(运动刷):精确控制物体运动- Director Mode(导演模式):高级摄像机控制- Multi-shot generation:多镜头序列生成- 34秒长视频生成(Gen-3 Alpha Turbo)【重要应用案例】《Everything Everywhere All At Once》(电影视觉特效)【融资信息】- 总融资:5.44亿美元- 最新估值:30亿美元(Series D,2025年Q2)- 投资者:Google、Nvidia、Salesforce Ventures、General Atlantic、Qatar Investment Authority【市场地位】专业电影制作的首选工具【用户群体】电影制作人、视觉特效艺术家、广告制作公司、独立创作者【竞争优势】1. 深度集成于电影工业2. 专业级的细粒度控制3. 快速的模型迭代4. 强大的社区和案例库【关键挑战】如何在保持专业性的同时扩大消费级市场【未来方向】预计集成入Adobe Premiere Pro等专业软件;进一步改进多角度视频生成能力

快速档案 · 下篇

“`

█████████████ Google Veo | 科技巨头的视觉理解

【公司名】Google DeepMind(Veo 项目)

【产品推出】2024年5月(Veo)

【主要版本】

- Veo(2024年5月):初代模型

- Veo 2(2024年12月):4K分辨率,物理理解提升

- Veo 3(2025年5月):原生音频生成

- Veo 3.1(2025年10月):图像到视频能力改进

- Veo 3.1 Fast(2025年10月):快速迭代模式

【核心能力】

- 文本到视频生成

- 图像到视频生成

- 原生音频生成(Veo 3及以后)

- 电影级画质

- 4K分辨率支持

【分发平台】

- VideoFX(专业工具)

- Google Gemini应用

- Google Photos(集成功能)

【技术基础】

- 大规模视频理解模型

- Google DeepMind的神经网络研究

- 全球最大级别的计算资源支持

【融资与资源】Google内部投资(作为Alphabet集团的一部分)

【市场地位】消费级内容创作的首选;企业级应用快速增长

【用户日均查询量】1000万+(截至2025年底)

【竞争优势】

- 科技巨头的资源保障

- 深度集成于Google生态

- 免费或低成本的高质量使用

- 快速的迭代周期

【主要限制】

- 有限的细粒度控制选项(相比Runway)

- 内容政策的限制(需要遵守Google的内容标准)

【未来方向】

- 进一步改进多语言音频生成

- 更深入的Creator Studio集成

- 可能的API开放

留下评论