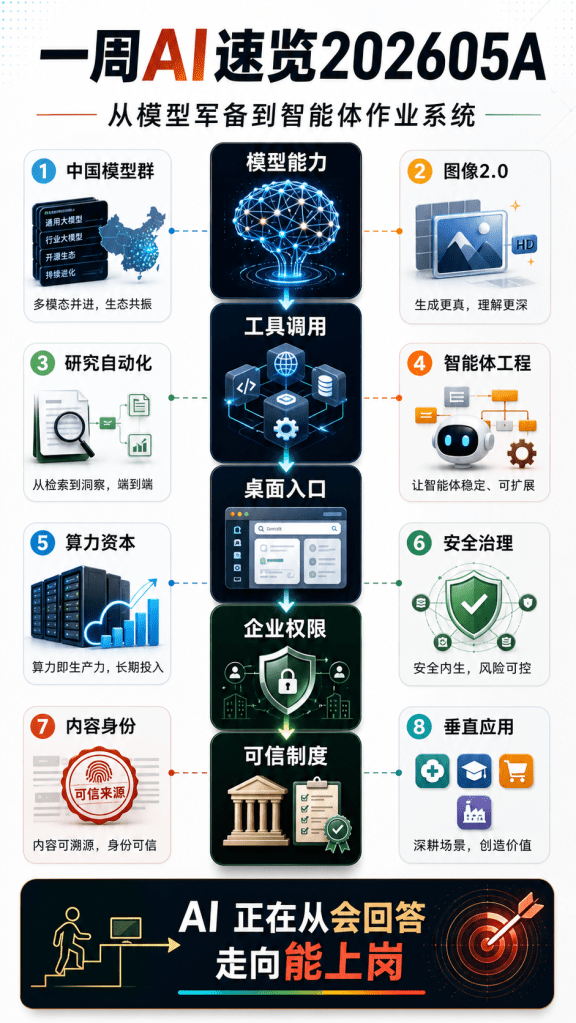

从模型军备到智能体作业系统:AI 的竞争正在从“大脑”转向“工位”

前言:能力竞赛开始长出“操作系统”的形状

2026 年 5 月第一周的 AI 新闻,表面看仍是熟悉的模型发布、融资传闻和产品更新:DeepSeek V4 Pro、Grok 4.3 Beta、Qwen 3.6 Max、Kimi K2.6、MiniMax M2.7、NVIDIA Nemotron 3 Nano Omni、ChatGPT Images 2.0 等名字密集出现。但如果把 Lev Selector、Last Week in AI 与 Matt Wolfe 三条周报合在一起看,本周真正的主线不是“又有多少模型刷新榜单”,而是模型正在被装进更具体的工作结构里。

过去两年,行业的默认问题是:谁的模型更强?现在问题变成:谁能把模型变成可靠的员工、研究员、程序员、设计师、销售助手、合规助理和安全分析员?这意味着竞争不再只发生在参数、上下文和基准测试上,而是发生在智能体框架、桌面入口、企业权限、算力供应、开源生态、内容平台和政府采购之间。

本周的关键词可以概括为一句话:AI 正在从“会回答”走向“能上岗”。但上岗之后,真正困难的部分也随之暴露:谁来规划任务,谁来验证结果,谁来控制成本,谁来承担越权和幻觉的后果?

一、DeepSeek、Grok 与中国模型群:榜单前排越来越拥挤

Lev Selector 的周更开场就提到 Crowd-sourced LM Arena 排行与 DeepSeek V4 Pro、Grok 4.3 Beta,并把“中国模型”单独作为章节。Matt Wolfe 也把 DeepSeek V4 Preview 放在视频第一条,随后列出 Qwen-Image-2.0-Pro、Kimi K2.6、MiniMax M2.7 等更新。Last Week in AI #242 则把阿里 Qwen 3.6 Max Preview、Moonshot 的 Kimi K2.6 和 MiniMax M2.7 放在“模型活动加速”的框架下讨论。

这说明模型市场已经进入一个更拥挤的阶段。美国前沿模型仍在定义高端能力上限,但中国模型正在以更快的节奏向开源、API、视觉生成、代码和智能体任务渗透。Kimi K2.6 被描述为 1T 参数 MoE 模型,MiniMax M2.7 强调自演化 agent 能力,Qwen 3.6 Max 转向更强 API 供给,Qwen-Image-2.0-Pro 则把多模态生成继续推向产品化。

这里的行业影响很直接:基础模型能力的“可替代区间”继续扩大。企业会越来越倾向于把普通任务交给更便宜、更可控、更容易私有化或区域合规部署的模型;闭源巨头则必须在最复杂、最高风险、最强工具调用场景中证明溢价。模型不再只是技术竞赛,也是供应链与成本结构竞赛。

二、ChatGPT Images 2.0:图像生成开始向“界面生成”靠拢

Last Week in AI 把 ChatGPT 新图像模型放在工具与应用章节的第一项,重点不是单纯“画得更好”,而是它在准确文字、截图式生成和结构化界面方面表现突出。这个变化很重要,因为它把图像生成从审美型工具推向任务型工具。

过去图像模型主要服务于海报、插画、概念图和社交媒体内容。现在,如果模型能够稳定生成包含准确文字、表格、UI、步骤说明和截图风格元素的图像,它就开始进入产品设计、教程制作、广告变体、演示文稿、落地页草图和应用原型领域。图像不再只是“看起来像”,而是要“能被理解、能被复用、能进入工作流”。

这也是 OpenAI “computer use” 与多模态智能体路线的一部分。一个能看屏幕、能生成屏幕、能解释界面、能操作界面的系统,最终争夺的是人机交互入口。图像生成的下一阶段,可能不是艺术模型之间的比拼,而是界面、文档、流程图和视觉证据生成的工程化比拼。

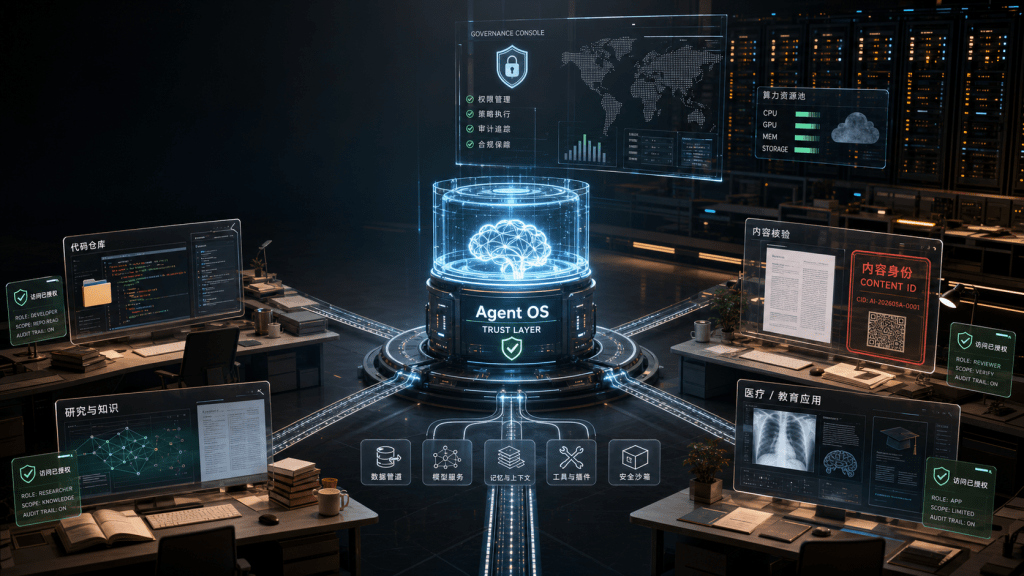

三、智能体工具链:从提示词技巧进入工程方法论

Lev Selector 的标题列表中,“Plan first, Code second, Verify always”几乎可以作为本周智能体工程的注脚。他还提到 Boris Cherny 的六步 Claude Code 系统、Claude Code 的十五条规则与工作流、GenericAgent、Hermes Agent、OpenClaw 问题、Agentic Harness、Personal Agent OS、如何降低 token 使用等主题。Matt Wolfe 同样关注 Mistral Vibe Remote Agents、Poolside Laguna Models、Claude Code/OpenClaw bug、HERMES.md 计费问题。

这些新闻背后有一个共同趋势:智能体正在从“把提示词写得更聪明”转向“把执行过程工程化”。规划、分解、执行、验证、成本控制、权限边界、日志回放、失败恢复,正在成为 AI 工具是否能落地的关键。一个能写代码的模型并不稀缺,一个能在真实仓库里有节制地改代码、跑测试、读错误、回滚风险、解释变更的系统才稀缺。

OpenClaw 与 HERMES.md 的问题也提醒行业:智能体越接近真实操作环境,越容易把小错误放大成真实损失。一个隐藏文件、一段上下文污染、一次不受控的工具调用,都可能触发计费、权限或安全事故。智能体工程的核心不是让 AI 更自由,而是让它在自由之前先学会被约束。

四、Google Deep Research Max 与 Gemini 文件生成:研究流程正在自动化

Google 本周的重点集中在 Deep Research Max、Gemini 3.1 Pro、MCP 支持和 Gemini 文件生成。Last Week in AI 提到 Deep Research Max 可以接入更复杂的研究任务,并通过 MCP 访问专有数据;Matt Wolfe 则列出 Gemini 生成文件、Google Translate 发音练习、Google Photos AI try-on 等应用层更新。

Deep Research Max 的意义不只是“搜索更强”。它暗示一种新的企业研究模式:AI 不再只在公开网页里整理答案,而是能跨内部知识库、文件、数据库、网页、邮件和业务系统完成研究。MCP 的加入,让“研究”从单一模型能力变成可插拔的数据访问和工具调用问题。

如果这个方向成熟,咨询、投研、市场分析、法务检索、竞品研究和技术调研都会被重塑。真正的壁垒不再是能不能写一份报告,而是能不能接入正确数据、保留引用链、区分事实与推断、让人类审稿人快速验证。研究自动化的终点不是无人写作,而是把昂贵的初稿劳动压缩到更短时间,把人类注意力留给判断和取舍。

五、浏览器、桌面与个人数字员工:AI 入口正在离开聊天框

Lev Selector 在视频中直接提出问题:你是否已经在使用个人数字“员工”?这不是一句营销话术,而是本周许多更新的共同背景。Claude Desktop 改进、Personal Agent OS、Hermes Agent、Mistral Remote Agents、Poolside Laguna、GenericAgent,都在把 AI 从单一网页对话推向更接近真实工位的执行环境。

这也是为什么“上下文长度”和“token 使用”会同时成为议题。数字员工需要长期任务记忆、项目资料、浏览器状态、代码仓库、会议记录、文件系统和外部 API,但无限制地把所有内容塞进上下文只会带来成本、延迟和泄密风险。未来的个人 AI 不会只是一个大上下文窗口,而会是一个会整理记忆、调用工具、分级授权、主动验证的工作系统。

对普通用户来说,这个转变会很快变得具体:AI 帮你查资料、整理邮件、更新表格、生成文件、准备会议、修改代码、写报告。对企业来说,真正要采购的不是“聊天机器人”,而是带权限治理的自动化岗位。AI 入口正在从聊天框走向桌面、浏览器和工作台。

六、算力、交易与资本:AI 基础设施仍在加速烧钱

商业新闻同样密集。Last Week in AI 提到 SpaceX 与 Cursor 的合作及 600 亿美元收购选项传闻、Cerebras 申请 IPO、Anthropic 从 Amazon 获得 50 亿美元并承诺 1000 亿美元 AWS 支出、Recursive Superintelligence 融资 5 亿美元、Xanadu 因 Nvidia 相关发布估值飙升。Matt Wolfe 则列出 OpenAI 与 Microsoft 下一阶段合作、OpenAI on AWS、Google 挑战 Nvidia 的新芯片计划等内容。

这说明 AI 行业的资本逻辑仍然围绕三个词:模型、算力、工作流。模型公司需要更大训练和推理预算,云厂商需要绑定大客户,芯片公司需要证明新架构价值,应用公司则需要尽快进入高频工作流。每一层都在争夺未来的利润池,也都在透支未来的增长预期。

风险同样明显。当天价云承诺、巨额融资和高估值收购选项不断出现,企业客户会开始追问:这些支出最终能否转化为生产率?如果智能体只是提高试错速度,却没有降低真实成本,那么泡沫会从应用层向基础设施层传导。2026 年的 AI 公司不只要讲能力故事,还要讲现金流故事。

七、政策与安全:AI 进入国家安全和平台治理的硬区

本周安全与政策线索非常突出。Last Week in AI 提到 NSA 使用 Anthropic 的 Mythos,另有关于 Anthropic 高级网络工具被未授权团体获取的报道;Matt Wolfe 提到 Google 与五角大楼的机密 AI 合作及员工抗议、Altman 与 Musk 诉讼、中国阻止 Meta 收购 Manus 的交易。Last Week in AI 还关注训练数据影响函数、OccuBench 职业任务评测、Parcae 循环语言模型等研究。

这些新闻说明 AI 已经不再只是互联网产品监管问题,而是国家安全、军工采购、网络攻防、跨境并购和供应链控制问题。强模型既能帮助发现漏洞,也可能帮助攻击者规模化漏洞利用;既能提高政府效率,也可能让私营公司深度嵌入国家安全系统;既能推动全球协作,也可能因为并购和芯片出口限制变成地缘政治工具。

治理难点在于,能力扩散比制度建设快。监管部门希望控制风险,企业希望抢占市场,开源社区希望降低门槛,政府机构希望获得能力优势。未来几个月,真正关键的问题可能不是哪家模型更强,而是谁能建立可审计、可追责、可被社会接受的高风险 AI 使用框架。

八、合成媒体与内容平台:从生成狂欢进入身份治理

Matt Wolfe 的清单里,ElevenMusic、Spotify verified badge、YouTube 名人 deepfake 下架请求、X 广告平台重构等新闻与 Last Week in AI 提到的 Deezer 数据形成呼应:Deezer 表示每日上传歌曲中 44% 为 AI 生成。这个比例即使存在口径差异,也足以说明内容平台已经进入新的治理阶段。

生成能力越便宜,内容供给越接近无限,平台的核心问题就从“如何鼓励创作”转向“如何识别身份、来源和权利”。音乐、视频、广告、声音克隆和名人肖像都会遭遇类似问题:谁是真实创作者?谁拥有授权?平台如何处理海量低成本内容?用户如何判断内容可信?

因此,Spotify 的认证标识和 YouTube 的 deepfake 处理并不是边角功能,而是平台在 AI 内容洪水中重建信任的基础设施。未来的内容平台会越来越像金融系统:身份、来源、授权、风控和申诉机制会成为核心竞争力。

九、垂直应用:医疗、教育、语言与试衣间里的 AI

除了宏大叙事,本周也有一组更贴近日常生活的应用更新。Matt Wolfe 提到 Mayo Clinic 使用 AI 早期检测胰腺癌、Google Translate 发音练习、Google Photos AI try-on、Gemini 文件生成、X 广告管理器重建。这些看似分散的功能,代表 AI 正在从“通用助手”下沉到具体场景。

医疗场景强调准确性和责任边界;语言学习强调即时反馈;虚拟试衣强调视觉一致性和消费转化;文件生成强调办公效率;广告管理强调自动化投放。它们不一定都需要最强模型,但都需要把模型嵌入具体流程、界面和数据闭环中。

这恰恰是 AI 普及的另一条路线:不是每个人都主动打开一个模型,而是模型出现在搜索、相册、翻译、购物、医院、广告后台和办公软件里。AI 的最大用户增长,可能不是来自新的聊天产品,而是来自旧软件被悄悄重写。

结语:智能体时代的胜负手,是把能力变成可靠制度

本周 AI 行业的共同信号很清楚:模型越来越强,但模型本身越来越不像最终产品。真正的竞争正在转向智能体框架、桌面入口、研究自动化、企业数据接入、内容身份治理、算力绑定和国家安全合规。

DeepSeek、Qwen、Kimi、MiniMax、Grok、ChatGPT、Gemini、Claude 等名字仍会继续占据 headlines,但下一阶段的赢家不只是“最聪明的模型”,而是能把模型放进可靠制度里的公司。它需要规划任务、控制权限、验证结果、管理成本、记录过程、处理责任,并且在开放与安全之间找到可持续边界。

AI 已经越过演示阶段,进入工位阶段。它开始坐到代码仓库、研究流程、企业文档、广告系统、医院和政府采购旁边。接下来真正重要的,不是它能不能做事,而是它做事的时候,是否值得信任。