透明度困境与伦理教育的复杂性

文章核心观点概述

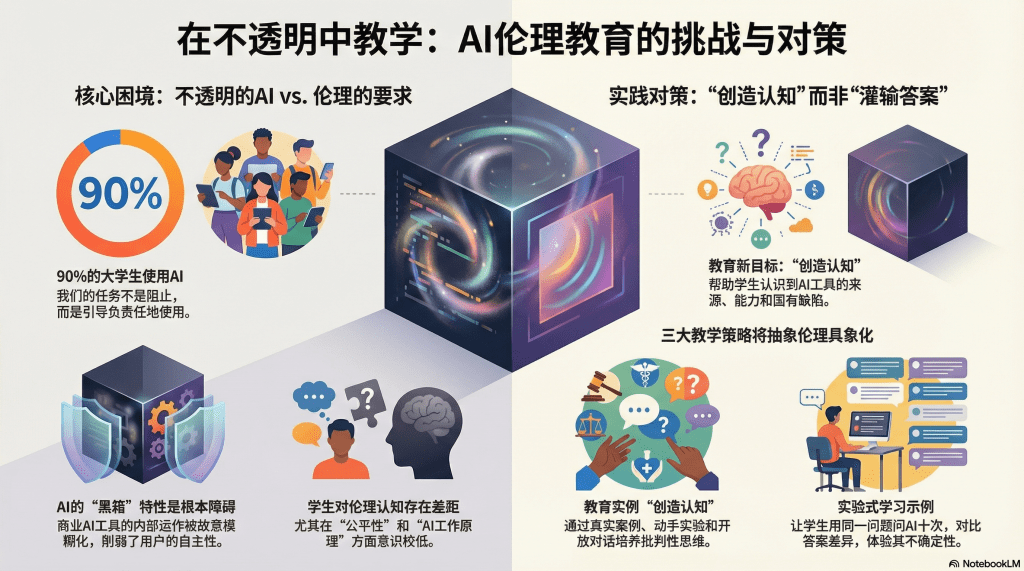

南卡罗来纳大学信息科学学院副教授Mónica Colón-Aguirre在《高等教育中以伦理为中心的AI素养的复杂性》一文中,从批判性视角揭示了AI伦理教育面临的一个根本性悖论:尽管伦理使用被视为AI素养的核心维度,但AI技术固有的不透明性使得伦理教育陷入结构性困境。

Colón-Aguirre文章的核心论点包括:

第一,90%大学生使用AI是不可逆转的现实。文章开篇即指出:“如今估计约90%的大学生在学术工作中使用生成式AI工具。”这意味着图书馆和教育者的角色不是“阻止使用”,而是“引导负责任的使用”。

第二,AI伦理的五个维度存在认知差距。文章援引数字教育委员会(DEC)的AI框架,指出AI伦理包括:公平性、透明度、问责制、隐私,同时认识到偏见、歧视和误信息的潜在风险。但研究发现,本科生在公平性认识和AI工作原理理解方面表现出较低的意识。

第三,AI的不透明性是伦理教育的结构性障碍。Colón-Aguirre一针见血地指出:“AI工具的内部运作对大多数人来说是故意模糊的。”这种不透明性削弱了人类自主性——而自主性是伦理使用技术的基本组成部分。

第四,图书馆员应“创造对短板的认知”。面对固有的不透明性和复杂性,Colón-Aguirre认为LIS专业人员的责任不是让用户掌握所有答案,而是“创造对工具来源、能力和缺陷的认知”。这是一种更谦逊、更现实的教育目标。

“透明度困境”的深层剖析

Colón-Aguirre提出的“透明度困境”触及了当代AI技术的一个根本性矛盾:

一方面,AI伦理框架普遍将“透明度”列为核心原则。另一方面,商业AI系统在实践中高度不透明:训练数据不公开、算法逻辑黑箱化、动态更新无通知。

这种透明度缺失不是技术限制,而是商业策略。问题在于:在这种结构性不透明的条件下,如何教育用户“透明地使用AI”?

学生认知差距的成因

Colón-Aguirre提到的研究发现值得深入分析:“本科生在公平性认识和理解AI如何工作方面表现出较低的意识。”

原因一:技术被“自然化”。对今天的大学生而言,AI已经无处不在,这种无处不在反而导致技术被视为“自然存在”,削弱了批判意识。

原因二:公平性问题的隐蔽性。与准确性等显性问题不同,公平性问题往往是隐蔽的:偏见可能只针对特定群体,不公平可能体现在统计层面而非个案。

原因三:技术理解的门槛过高。但学生不需要成为AI专家,只需理解几个关键概念:AI生成的是基于统计相关性的预测而非理解、训练数据的偏见会系统性反映在输出中、AI没有“知道”只有模式匹配。

中国语境下的伦理教育挑战

挑战一:技术乐观主义的文化氛围。在“AI强国”的国家战略叙事下,质疑AI的公平性或透明度可能被误解为“不与时俱进”。但LIS专业人员的责任恰恰是保持批判距离。

挑战二:数据治理的制度差异。中国的相关法规在某些方面比西方更严格,但执行效果如何?用户的知情权和选择权如何保障?这些是图书馆AI伦理教育应当涉及但也最敏感的议题。

挑战三:跨文化的公平性标准。西方强调个体权利,中国更强调集体和谐。这种差异需要图书馆的AI伦理教育既立足本土价值观,又保持对全球伦理讨论的开放性。

实践启示:“创造认知”而非“灌输答案”

Colón-Aguirre的“创造认知”理念可转化为三个策略:

策略一:案例式教学,让抽象伦理具象化。通过真实案例讨论,让学生亲身感受伦理问题的真实影响。

策略二:实验式学习,让黑箱部分透明。通过简单实验让学生理解AI运作逻辑:用同样问题问ChatGPT十次对比差异、故意输入带有刻板印象的提示词观察输出、检验引文真实性等。

策略三:对话式教学,培养“不确定性容忍”。承认“我们也不完全知道”,创造共同探究的氛围,培养学生的批判性思维。

深层反思:伦理教育的限度

Colón-Aguirre的文章也隐含着对伦理教育限度的清醒认识:个体伦理素养无法替代制度性改革。

因此,图书馆员的角色不应止于教育,还应包括倡导:倡导AI监管政策要求强制透明、倡导教育机构采购AI工具时设定伦理标准、倡导学术界抵制不透明的AI系统。

这是从“教育者”到“变革推动者”的角色扩展,也是图书馆公共责任的体现。

结语:在不透明中保持清醒

Colón-Aguirre的文章诚实地承认:在当前技术和商业现实下,完美的AI伦理教育是不可能的。我们能做的,是在不透明中保持清醒,在不确定中坚守价值。

适应,不是妥协;清醒,就是抵抗。这或许就是AI时代图书馆员最重要的伦理立场。

留下评论